京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

一个好的数据分析模型不仅能使分析具备条理性和逻辑性,而且还更具备结构化和体系化,并保证分析结果的有效性和准确性。好的数据分析师不仅熟练地掌握了分析工具,还掌握了大量的数据分析方法和模型。

今天就来给大家分享12种常用的业务数据分析模型和方法,希望对大家有所帮助!

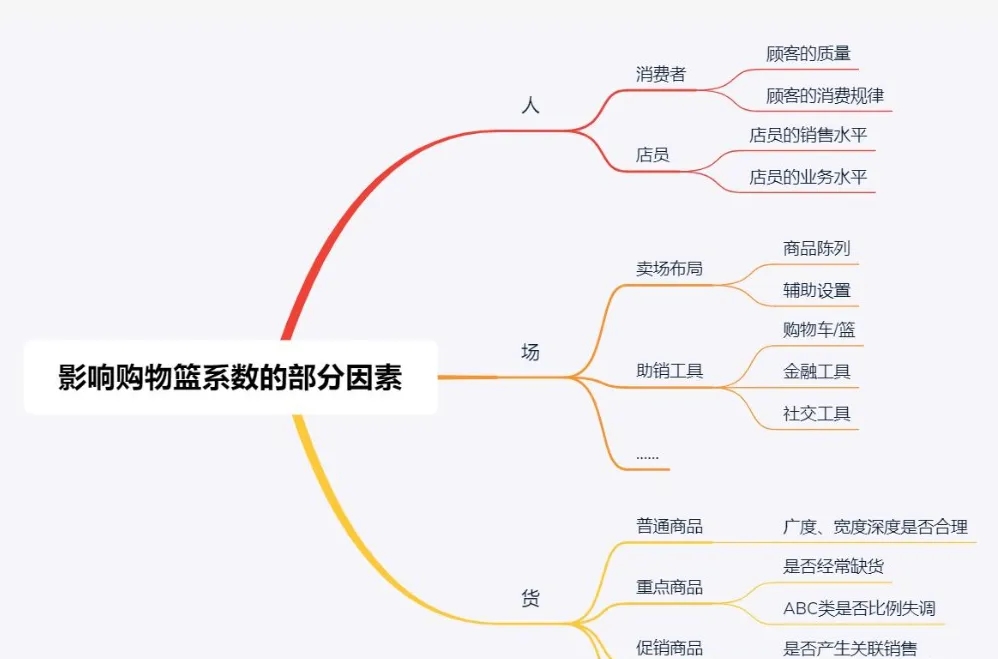

购物篮分析主要用于发现商品之间的购买关系和模式。通过关联规则学习来识别哪些商品经常一起被购买,从而帮助制定捆绑销售或推荐系统。

这个模型一般是用来找出顾客购买行为的模式:

操作步骤:

(1)数据准备:收集客户的购买记录,形成事务数据集。

(2)应用算法:使用关联规则算法(如Apriori)来找出商品之间的关联规则。

(3)设置参数:设置最小支持度(商品组合出现的最小频率)、最小置信度(商品A出现时商品B出现的条件概率)。

(4)分析结果:解读算法输出的规则,找出常见的商品组合,用于商品推荐或捆绑销售。

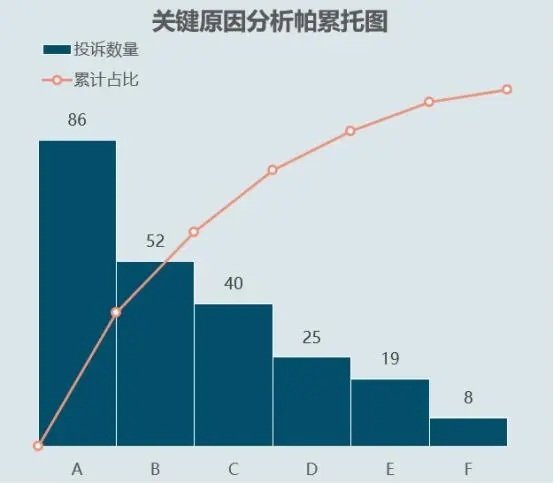

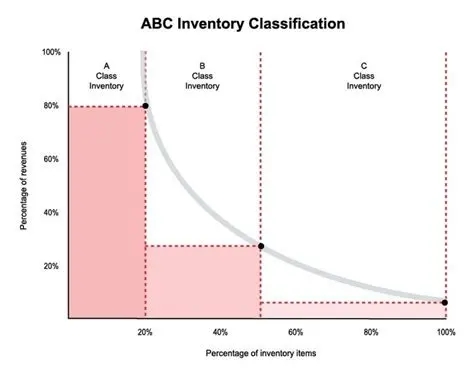

帕累托分析(Pareto Analysis)和ABC分析(ABC Analysis)是两种常用的分类工具,广泛应用于库存管理、销售分析和客户细分等领域。

帕累托原则指出,在很多情况下,80%的效果来自于20%的原因。帕累托分析利用这一原则,通过识别和聚焦于最重要的20%因素,来优化资源和提升效率。但并不是所有情况都严格遵循8/2的比例,有时可能是7/3或9/1等。

帕累托分析在多个领域有广泛应用,其主要作用包括:

帕累托分析适用于多种场景,包括但不限于:

ABC分析是一种基于帕累托原则的分类方法,将项目或客户按重要性划分为A、B、C三类。通常A类项目占总数的少部分但贡献最大,B类次之,C类占大部分但贡献较小。所以这一篇是把两种方法放在了一起。

ABC分析的主要作用包括:

ABC分析广泛用于库存管理、客户管理和产品管理等领域:

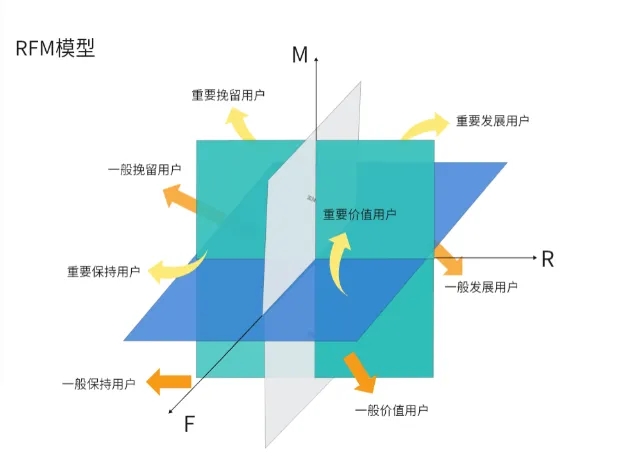

RFM 分析是美国数据库营销研究所提出的一种客户分析方法。该模型基于客户的最近购买时间(Recency)、购买频率(Frequency)、购买金额(Monetary)来评估客户的价值和分类。通过这三个维度的组合,将客户分为不同的群体,比如高价值客户、需要挽留的客户等,以便实施针对性的营销策略。

操作步骤:

(1)收集数据:整理客户购买记录,包括购买日期、频率和消费金额。

(2)计算指标:为每个客户计算R(最近一次购买时间距今天数)、F(特定时间内购买次数)、M(特定时间内消费总金额)。

(3)分级:根据RFM的高低,将客户分为不同的等级或群体,例如R为1-30天为高,31-90天为中,超过90天为低。

(4)分析应用:根据RFM等级,制定不同的营销策略,例如对高RFM客户进行忠诚度奖励,对低RFM客户进行挽留策略。

4P营销理论模型是随着营销组合理论的提出而出现的,产生于20世纪60年代的美国。该模型常用于企业营销状况分析、商品销售策略分析。

4P营销模型由4个要素构成,即产品(Product)、价格(Price)、渠道(Place)、宣传(Promotion)。

4P营销模型的操作步骤可以总结为以下几个关键环节:

了解产品:首先,企业需要对产品进行全面的了解,包括产品的特性、质量、设计、品牌名称、包装、服务、保证和退货政策等。这一步骤是制定有效营销策略的基础,确保产品能够满足市场需求并具有竞争力。

决定价格:接下来,企业需要根据成本、盈利能力、目标用户的支付能力和市场定位等因素来确定产品的价格。定价策略应考虑折扣、促销活动和支付方式等因素,以确保产品在目标市场中具有吸引力。

选择销售地点:企业需要选择合适的销售渠道和分销网络,以确保产品能够有效地到达目标客户群。这包括考虑潜在客户的购物习惯、竞争对手的销售地点、最佳购买体验和售后支持等因素。

制定推广策略:最后,企业需要制定全面的推广策略,包括广告、销售促进、公共关系和直接营销等手段。这些活动旨在提高品牌知名度并刺激销售。

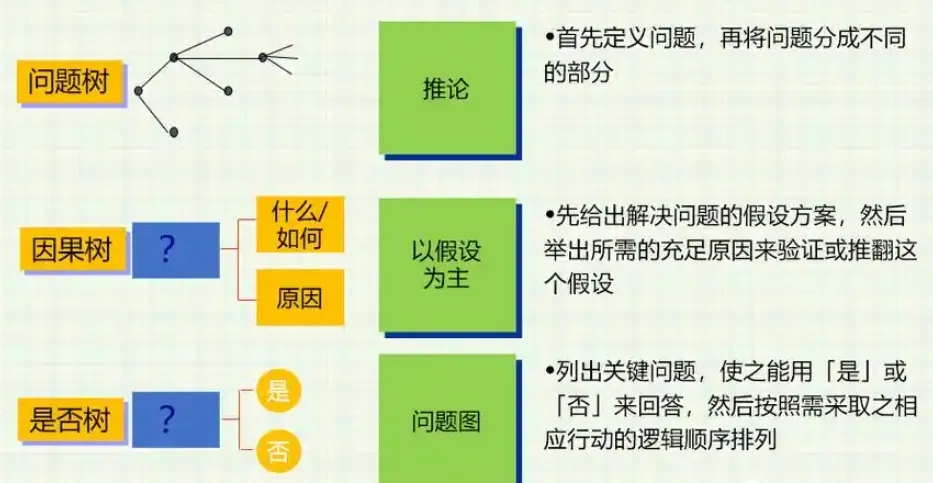

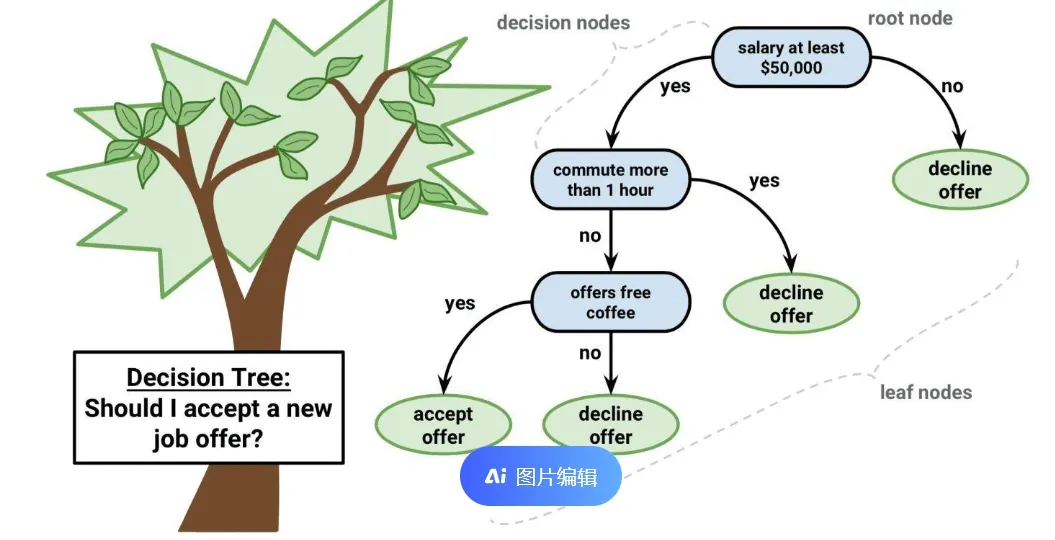

逻辑树模型又称问题树、演绎树或分解树模型。是一种通用的分析模型,广泛适合于各种情况下的问题分析,作用在于层层分解、追本溯源,找到问题的症结所在。

逻辑树的基本结构是,从最高层开始,逐步向下扩展分解。即将一个已知的大问题当成最高层,然后考虑与该问题相关的因素,每考虑到一个点,就添加一根“树枝”,以此类推,将每个问题都细化到最小处,最终形成一颗“逻辑树”。

逻辑树模型可以帮助在数据分析时理清思路,不再重复、混乱的思考。且保证数据分析时的全面性,不遗漏任何细枝末节。同时确定各环节的重要程度,做到主次分明,责任落实。

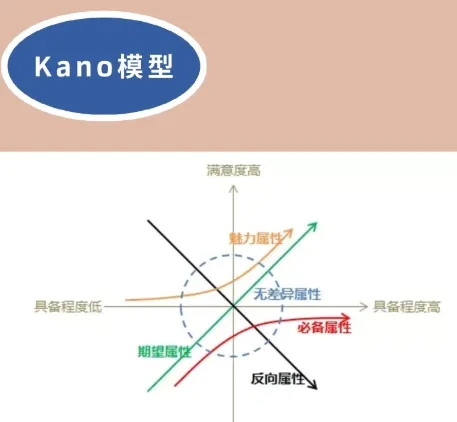

KANO模型是一种需求分析和优先级排序工具,将商品属性分为必备性需求、期望型需求、兴奋性需求、无差异需求四类。通过理解不同类型的需求对用户满意度的影响,确定产品特性的优先级。

操作步骤:

(1)需求收集:通过问卷调查、用户访谈等方式收集用户需求。

(2)分类需求:将需求分为四类。

(3)优先排序:根据需求对用户满意度的影响程度进行排序。

(4)产品规划:根据优先级和资源情况,规划产品特性的开发顺序。

CDA认证小程序里面有很多SQL题,数据分析模型的测试,扫码CDA认证小程序,测一测你对数据分析模型的掌握程度。

CDA 考试官方报名入口:https://www.cdaglobal.com/pinggu.html

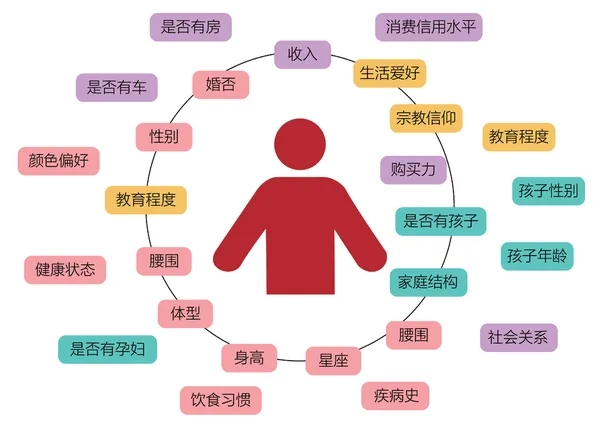

用户画像分析(User Profiling Analysis)是一种市场研究技术,它通过收集和分析用户的各种数据来创建用户的详细描述,这些描述通常包括用户的行为、偏好、心理特征、生活方式等。

用户画像的目的是为了更好地理解目标客户群体,以便为他们提供更加个性化的产品和服务,提高营销效率和客户满意度。

用户画像分析用一句话来总结就是:用户信息标签化。

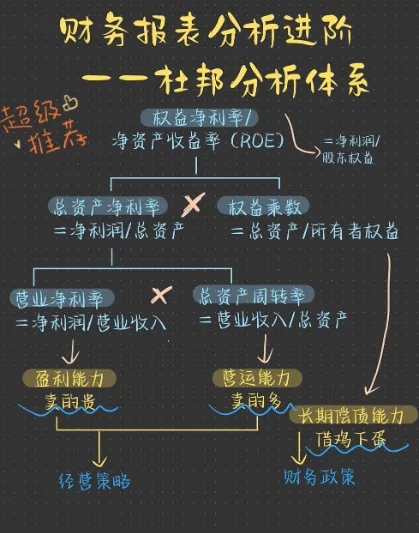

杜邦分析是一种综合财务分析方法,通过分解净资产收益率(ROE)为多个财务比率的乘积,以评估企业的盈利能力、资产运营效率和财务杠杆。杜邦分析的基本思想是将ROE分解为销售净利润率、资产周转率和权益乘数,从而深入分析企业的经营业绩。

操作步骤:

(1)数据处理:准备企业的利润和资产负债数据。

(2)合并数据表:将利润数据和资产负债数据合并,以便于进行综合分析。

(3)计算关键指标:分别计算销售净利润率、资产周转率和权益乘数。销售净利润率反映盈利能力,资产周转率反映资产运营效率,权益乘数则衡量财务杠杆。

(4)净资产收益率的计算:将上述三个指标相乘,得出净资产收益率。

(5)结果分析:通过分析ROE及其分解指标,评估企业的财务状况和经营效率。

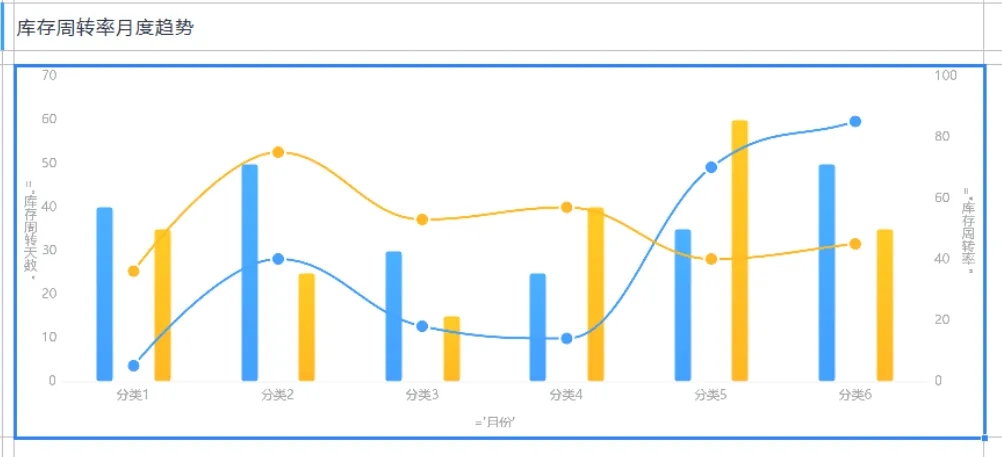

库存周转分析是衡量企业存货管理效率的重要工具,通过分析库存周转率和周转天数,反映存货的流动性和销售效率。

高周转率和低周转天数意味着存货快速变现,资金流转效率高,销售状况良好。

操作步骤:

(1)数据处理:上传库存相关的数据集,对上传好的数据进行清洗和整理,确保数据的准确性和可用性。

(2)计算关键指标:根据公式计算平均存货余额、销货成本、库存周转率和库存周转天数。

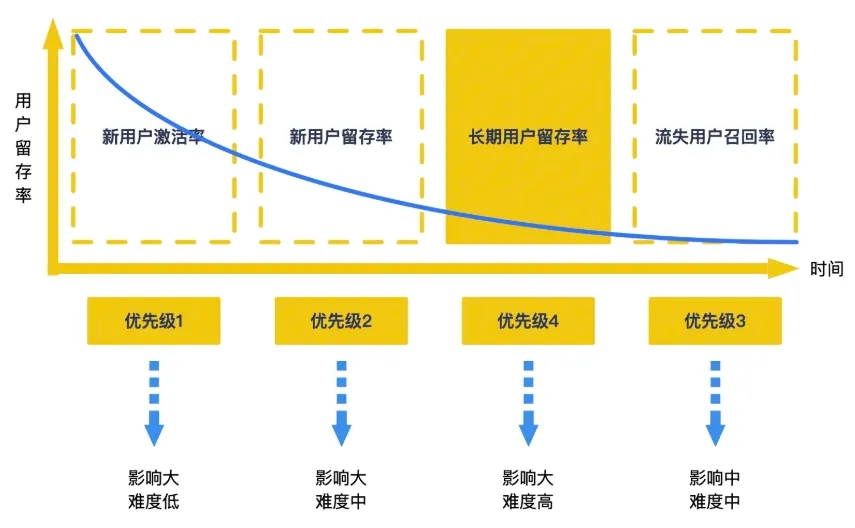

留存分析用于衡量用户在一段时间后继续使用产品或服务的情况。通过计算特定时间段内新用户在后续时间段内再次使用产品的比例,评估用户忠诚度和产品粘性。

操作步骤:

(1)确定时间窗口:选择一个时间段作为新用户的起始点,如第一个月。

(2)跟踪用户:记录在起始时间窗口内的所有新用户。

(3)计算留存率:在后续的每个时间点,统计起始时间窗口内用户中有多少人仍然活跃。

(4)分析趋势:通过留存曲线分析用户留存情况,找出留存下降的原因并制定改进措施。

时间流是了解用户在产品内流转行为的最佳方法。事件流分析通过桑基图,可以理解用户在做完任一行为之后的流向,也可以了解转化的用户是如何一步步完成转化的,以此判断用户的取向是否符合预设路径。

通过事件流分析可以回答以下问题:

用户行为路径是否与预设的路径一致?

产品迭代后,用户行为,路径是否有变化?

产品的流失用户去了哪里,为什么流失?

产品设计是否给用户带来了最佳体验?

事件流分析的操作步骤可以总结为以下几个关键环节:

事件捕获:首先,需要收集传入的事件流。这一步骤通常涉及从各种数据源中提取事件数据,并将其转换为适合进一步处理的格式。

事件路由:将捕获到的事件分配给不同的处理任务。这一步骤确保每个事件能够被正确地传递到相应的处理模块或函数中。

事件聚合:对相关事件进行分组和聚合处理,以便于后续的分析和洞察生成。这一步骤有助于识别模式和趋势。

事件分析:通过聚合、关联和时间分析等方法,对事件流进行深入分析。例如,利用时间分析来识别活动的突然增加等潜在问题。

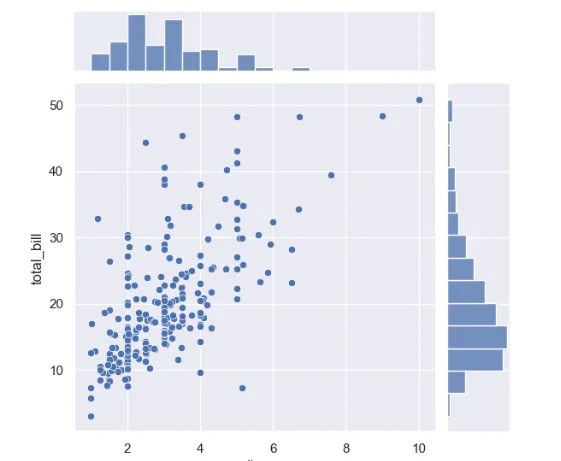

分布分析主要用来了解不同区间时间的发生频次、不同事件计算变量的加和,以及不同页面浏览时长等区间的用户数量分布。

作为UE、产品想要集中优化最重要的页面,需要知道关键页面浏览量的频次分布,找到对用户影响最大的页面;作为运营人员,无差别的用户运营会让人精疲力竭,需要知道贡献值靠前的用户分群,集中资源用于中重点用户。

分布分析的操作步骤:

计算极差:首先,需要计算数据的最大值和最小值之间的差值,即极差。这一步骤帮助确定数据的范围。

确定组距与组数:根据极差,选择合适的组距(每个区间的长度)和组数(区间总数)。

确定分点:在每个区间内确定分点,即区间的端点。这些分点将数据划分为若干个区间。

列出频率分布表:将数据按照分点进行分组,并计算每个区间的频数,即该区间内数据出现的次数。

绘制频率分布直方图:使用直方图或其他可视化工具(如茎叶图、箱线图等)来展示频率分布表中的数据,以便更直观地理解数据的分布特征。

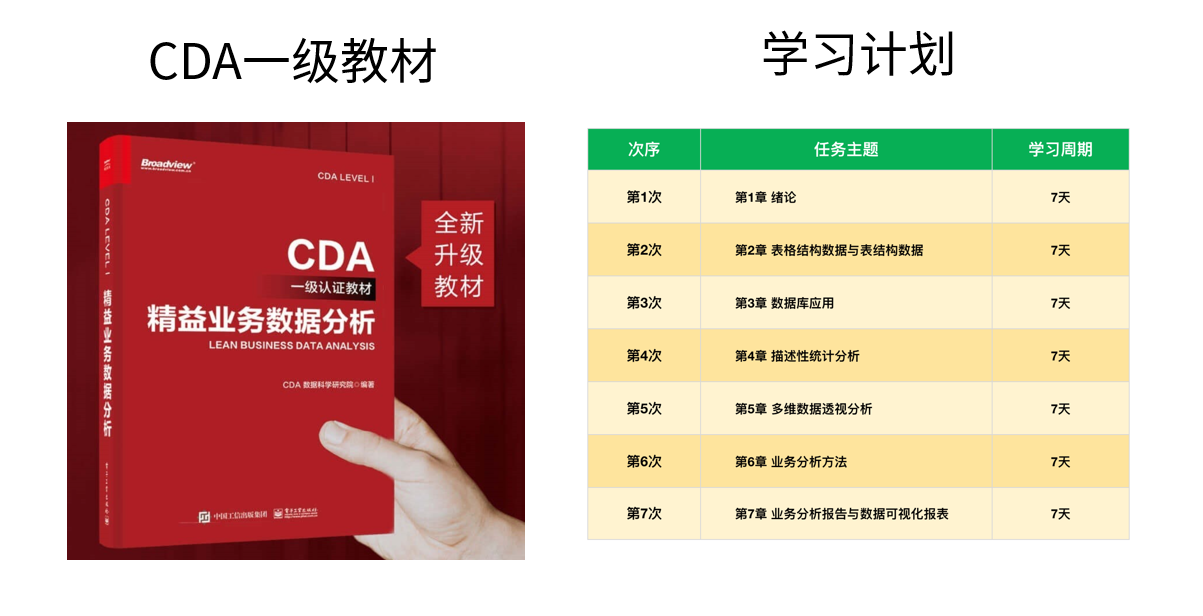

《CDA一级教材》在线电子版正式上线CDA网校,为你提供系统、实用、前沿的学习资源,助你轻松迈入数据分析的大门!

免费加入阅读:https://edu.cda.cn/goods/show/3151?targetId=5147&preview=0

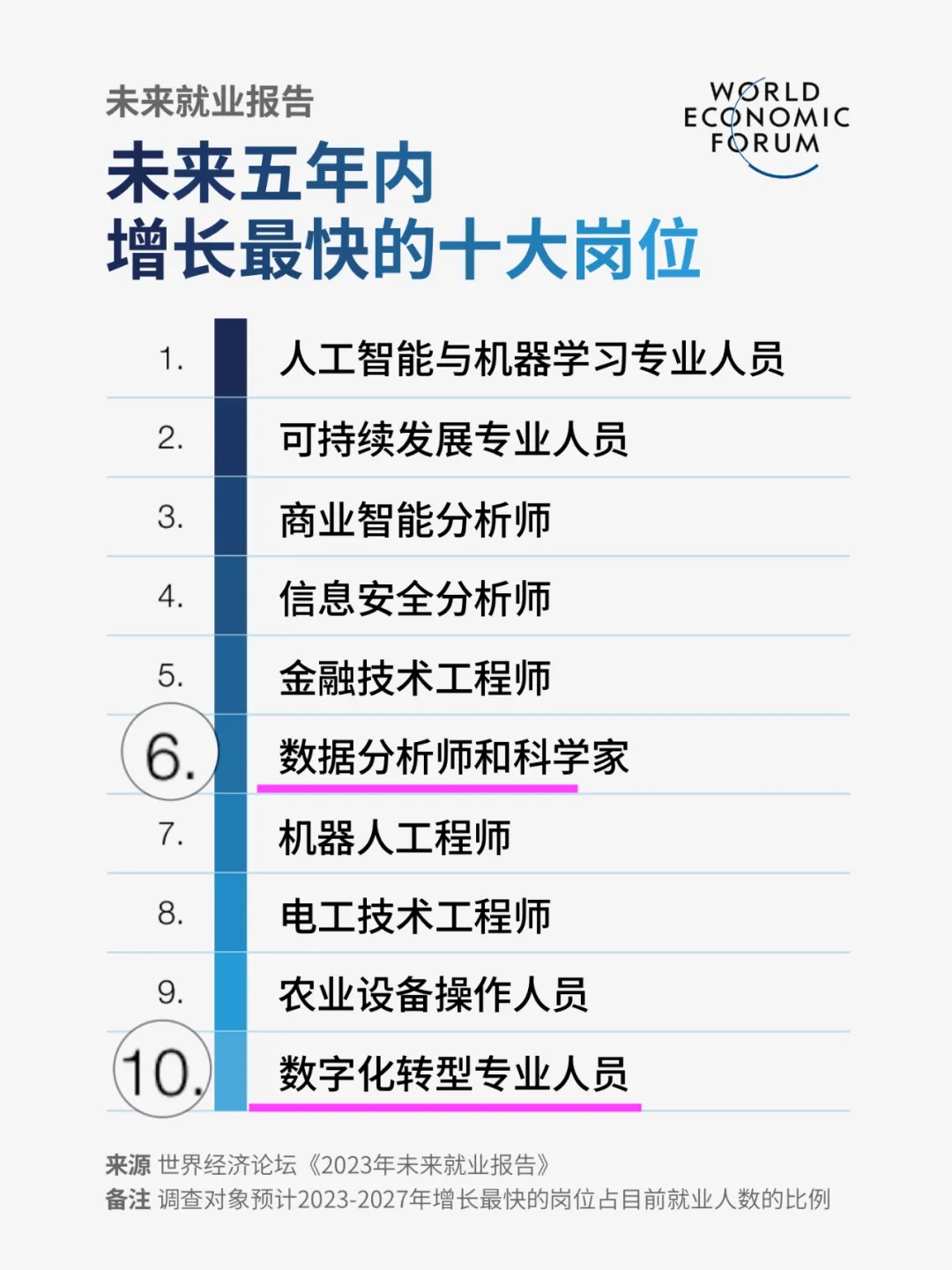

对于所有有志于做数据分析师、商业数据分析、数据治理的小伙伴,一定要加快提升自己。世界经济论坛发布的《2023年未来就业报告》对未来五年就业市场进行深入分析,报告预测未来5年内增长最快的十大岗位,就包括了数据分析师和科学家以及数字化转型专业人员。

强烈建议重视CDA数据分析师证书,CDA数据分析师一级考试涉及的多个业务分析模型,这些模型在实战中超有用。尤其是想进入电网、银行、电信、烟草行业的小伙伴们,尽量考过CDA数据分析师二级,因为这些单位几乎都会在招聘中说明CDA数据分析师优先。

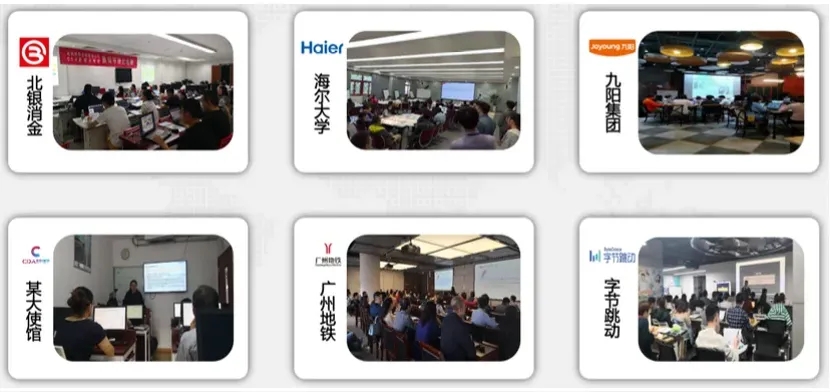

近年来CDA数据分析师已经为招行、华为、长安、苏宁等近百家机构提供了专业的内训服务。通过这些课程培训,企业员工能够掌握数据分析的技能,更好地理解和利用大数据,提升数据驱动的决策能力,支持企业的数字化转型和业务发展。

随着各行各业进行数字化转型,数据分析能力已经成了职场的刚需能力,这也是这两年CDA数据分析师大火的原因。和领导提建议再说“我感觉”“我觉得”,自己都觉得心虚,如果说“数据分析发现……”,肯定更有说服力。想在职场精进一步还是要学习数据分析的,统计学、概率论、商业模型、SQL,Python还是要会一些,能让你工作效率提升不少。备考CDA数据分析师的过程就是个自我提升的过程,CDA小程序资料非常丰富,包括题库、考纲等,利用好了自学就能考过。

CDA 考试官方报名入口:https://www.cdaglobal.com/pinggu.html

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在数据统计分析中,卡方检验是一种常用的非参数检验方法,核心用于判断两个或多个分类变量之间是否存在显著关联,广泛应用于市场 ...

2026-05-18在企业数字化转型的浪潮中,很多企业陷入了“技术堆砌”的误区——上线了ERP、CRM、BI等各类系统,积累了海量数据,却依然面临“ ...

2026-05-18小陈是某电商平台的数据分析师。老板交给他一个任务:“我们平台的注册用户已经突破1000万了,想了解一下用户的平均月消费金额。 ...

2026-05-18【专访摘要】本次CDA持证专访邀请到拥有丰富物流供应链数据分析经验的赖尧,他结合自身在京东、华莱士、兰格赛等企业的从业经历 ...

2026-05-15在数字化时代,企业的每一次业务优化、每一项技术迭代,都需要回答一个核心问题:这个动作到底能带来多少价值?是提升了用户转化 ...

2026-05-15在数据仓库建设中,事实表与维度表是两大核心组件,二者相互关联、缺一不可,共同构成数据仓库的基础架构。事实表聚焦“发生了什 ...

2026-05-15 很多数据分析师沉迷于复杂的机器学习算法,却忽略了数据分析最基础也最核心的能力——描述性统计。事实上,80%的商业分析问 ...

2026-05-15【核心关键词】互联网、机会、运营、关键词、账户、数字化、后台、客户、成本、网络、数据分析、底层逻辑、市场推广、数据反馈 ...

2026-05-14在Python数据分析中,Pandas作为核心工具库,凭借简洁高效的数据处理能力,成为数据分析从业者的必备技能。其中,基于两列(或多 ...

2026-05-14 很多人把统计学理解为“一堆公式和计算”,却忽略了它的本质——一门让数据“开口说话”的科学。真正的数据分析高手,不是会 ...

2026-05-14在零售行业存量竞争日趋激烈的当下,客户流失已成为侵蚀企业利润的“隐形杀手”——据行业数据显示,零售企业平均客户流失率高达 ...

2026-05-13当流量红利消退、用户需求日趋多元,“凭经验决策、广撒网投放”的传统营销模式早已难以为继。大数据的崛起,为企业营销提供了全 ...

2026-05-13 许多数据分析师精通Excel函数和SQL查询,但当面对一张上万行的销售明细表,要快速回答“哪个地区销量最高”“哪款产品增长最 ...

2026-05-13在手游行业存量竞争日趋激烈、流量成本持续高企的当下,“拉新”早已不是行业核心痛点,“留存”尤其是“付费留存”,成为决定手 ...

2026-05-12 很多数据分析师掌握了Excel函数、会写SQL查询,但当被问到“数据从哪里来”“数据加工有哪些步骤”“如何使用分析工具连接数 ...

2026-05-12用户调研是企业洞察客户需求、优化产品服务、制定运营策略的核心前提,而调研数据的可靠性,直接决定了决策的科学性与有效性。在 ...

2026-05-11在市场竞争日趋激烈、流量成本持续攀升的今天,企业的核心竞争力已从“获取流量”转向“挖掘客户价值”。客户作为企业最宝贵的资 ...

2026-05-11 很多数据分析师精通Excel单元格操作,熟练应用多种公式,但当被问到“表结构数据的基本处理单位是什么”“字段和记录的本质 ...

2026-05-11在互联网运营、产品优化、用户增长等领域,次日留存率是衡量产品价值、用户粘性与运营效果的核心指标,更是判断新用户是否认可产 ...

2026-05-09相关性分析是数据分析领域中用于探究两个或多个变量之间关联强度与方向的核心方法,广泛应用于科研探索、商业决策、医疗研究、社 ...

2026-05-09