京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

在数据驱动决策的时代,数据分析已成为各行业不可或缺的核心能力。而 Python 凭借其丰富的库生态、简洁的语法和强大的扩展性,成为数据分析领域的首选工具之一。无论是处理结构化数据、进行探索性分析,还是构建可视化报告,Python 都能提供高效且灵活的解决方案。本文将详细介绍如何用 Python 进行数据分析,从环境搭建到实战应用,带你掌握数据分析的全流程技能。

Python 之所以能在数据分析领域脱颖而出,得益于其独特的优势和完善的生态体系。

Python 语法简洁易懂,接近自然语言,即使是非计算机专业的数据分析从业者,也能快速上手编写代码。与其他编程语言相比,Python 代码的可读性更高,便于团队协作和后期维护。同时,Python 具有出色的跨平台兼容性,在 Windows、macOS 和 Linux 系统上都能稳定运行,确保数据分析工作不受操作系统限制。

更重要的是,Python 拥有海量的第三方库,这些库专门针对数据分析的不同环节进行了优化,能极大提升数据分析的效率。从数据获取、清洗到分析、可视化,Python 库生态几乎覆盖了数据分析的全流程,让分析师可以专注于业务逻辑而非底层技术实现。

Python 数据分析生态中,几个核心库构成了完整的技术栈。NumPy 是科学计算的基础库,提供了高效的多维数组操作和数学函数,为数据处理提供了底层支持。Pandas 则是数据分析的核心工具,它引入了 DataFrame 数据结构,能轻松处理结构化数据,实现数据的清洗、筛选、聚合等操作。

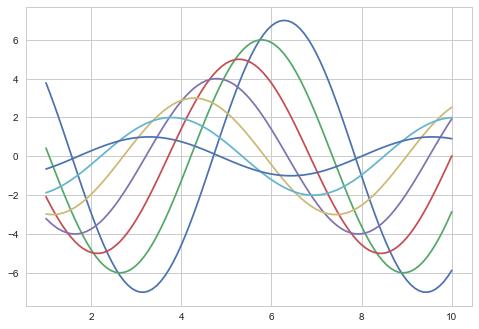

Matplotlib 和 Seaborn 是可视化领域的佼佼者,Matplotlib 提供了底层绘图接口,支持绘制各种静态图表;Seaborn 基于 Matplotlib 封装,能更便捷地生成美观且专业的统计图表。对于更复杂的数据分析任务,Scikit-learn 提供了丰富的机器学习算法,可用于数据建模和预测分析。这些库相互配合,形成了强大的 Python 数据分析生态系统。

开始 Python 数据分析之旅前,需要搭建合适的开发环境,选择合适的工具和库安装方式至关重要。

常用的 Python 开发环境有 Anaconda 和纯 Python 环境两种。Anaconda 是一个数据科学发行版,内置了 Python 解释器以及数据分析常用的库,还包含 Spyder、Jupyter Notebook 等开发工具,一键安装即可使用,特别适合初学者。

Jupyter Notebook 是数据分析中广泛使用的交互式开发工具,它支持实时代码运行、富文本编辑和图表嵌入,能将代码、说明文字和可视化结果整合在一个文档中,非常适合探索性分析和报告编写。而 PyCharm 作为专业的 Python IDE,具有强大的代码补全、调试和项目管理功能,更适合大型数据分析项目开发。

如果使用 Anaconda,大部分核心库已预装,无需额外操作。在纯 Python 环境中,可以通过 pip 工具安装所需库。安装 NumPy 可使用命令 “pip install numpy”,安装 Pandas 用 “pip install pandas”,Matplotlib 和 Seaborn 分别通过 “pip install matplotlib” 和 “pip install seaborn” 安装。

安装完成后,在 Python 脚本或 Jupyter Notebook 中通过 import 语句导入库即可使用,例如 “import numpy as np”“import pandas as pd”,通常会为库设置简称以简化代码编写。

用 Python 进行数据分析通常遵循一套标准化流程,每个环节都有对应的工具和方法,确保数据分析的科学性和高效性。

数据分析的第一步是将数据加载到 Python 环境中。Pandas 支持多种数据格式的读取,对于 CSV 文件,使用 “pd.read_csv ('file.csv')” 即可轻松加载;Excel 文件可通过 “pd.read_excel ('file.xlsx')” 读取;JSON 格式数据则用 “pd.read_json ('file.json')” 处理。

以经典的鸢尾花数据集为例,在 Scikit-learn 库中内置了该数据集,可直接通过代码加载:

from sklearn.datasets import load_iris

import pandas as pd

iris = load_iris()

df = pd.DataFrame(data=iris.data, columns=iris.feature_names)

df['species'] = iris.target

这段代码将鸢尾花数据转换为 Pandas DataFrame 格式,方便后续分析,其中 “species” 列表示鸢尾花的品种。

原始数据往往存在缺失值、异常值和重复数据等问题,需要通过数据清洗提升数据质量。Pandas 提供了丰富的函数用于数据清洗,“df.isnull ().sum ()” 可统计各列缺失值数量,对于缺失值,可根据情况使用 “df.fillna ()” 填充或 “df.dropna ()” 删除。

检测异常值常用箱线图或 Z-score 方法,例如用 “df.describe ()” 查看数据的统计描述,识别超出合理范围的数值。对于重复数据,“df.duplicated ().sum ()” 可检测重复行数量,“df.drop_duplicates ()” 能删除重复数据。在鸢尾花数据集中,数据质量较高,几乎无需复杂清洗,但在实际业务数据中,数据清洗往往是最耗时的环节。

探索性数据分析旨在通过统计和可视化方法了解数据特征,发现潜在规律。Pandas 的 “df.describe ()” 可生成数据的基本统计量,包括均值、标准差、最大值、最小值等,快速把握数据分布。“df.corr ()” 能计算特征间的相关系数,分析变量间的相关性。

可视化是探索性分析的重要手段,Matplotlib 和 Seaborn 可绘制各种图表。例如,用 Seaborn 绘制鸢尾花花瓣长度的直方图,观察其分布情况:

import seaborn as sns

import matplotlib.pyplot as plt

sns.histplot(data=df, x='petal length (cm)', hue='species', multiple='stack')

plt.title('Distribution of Petal Length by Species')

plt.show()

通过散点图可分析两个特征的关系,如花瓣长度与花瓣宽度的散点图能直观展示不同鸢尾花品种的特征差异,为后续分析提供方向。

在探索性分析的基础上,需要进行更深入的数据处理和分析。Pandas 的分组聚合功能非常强大,“df.groupby ('species').mean ()” 可按鸢尾花品种分组,计算各特征的平均值,比较不同品种的特征差异。

数据筛选也是常用操作,例如筛选出花瓣长度大于 5cm 的样本:“df [df ['petal length (cm)'] > 5]”。对于时间序列数据,Pandas 还提供了时间索引、重采样等功能,方便进行时序分析。通过这些操作,能从数据中提取有价值的信息,为决策提供支持。

数据可视化是数据分析的最后一公里,将分析结果以直观的图表形式呈现,便于理解和沟通。除了前面提到的直方图和散点图,Python 还能绘制折线图、柱状图、箱线图、热力图等多种图表。

用 Seaborn 绘制鸢尾花特征的箱线图,可清晰展示不同品种特征的分布差异:

plt.figure(figsize=(10, 6))

sns.boxplot(data=df, x='species', y='petal length (cm)')

plt.title('Petal Length Distribution by Iris Species')

plt.show()

correlation = df.corr()

sns.heatmap(correlation, annot=True, cmap='coolwarm')

plt.title('Correlation Heatmap of Iris Features')

plt.show()

这些可视化图表能让复杂的数据关系变得清晰易懂,增强分析结果的说服力。

掌握基础流程后,学习一些进阶技巧能进一步提升数据分析能力,应对更复杂的分析场景。

将重复的分析步骤封装成函数,可提高代码复用性和可维护性。例如,编写一个绘制多种特征直方图的函数,避免重复编写代码。循环结构可用于批量处理多个文件或多个特征,结合列表推导式能简化代码,提高运行效率。

实际分析中常需要处理多个数据集,Pandas 的 “merge ()”“concat ()” 等函数可实现数据的合并与连接。根据共同的键将不同数据集合并,能整合多源数据进行综合分析,例如将鸢尾花的特征数据与外部的生长环境数据合并,分析环境对鸢尾花特征的影响。

利用 Jupyter Notebook 结合 Markdown 语法,可生成包含代码、文字说明和图表的交互式报告。通过 Nbconvert 工具,还能将 Notebook 转换为 HTML、PDF 等格式,方便分享和展示。对于定期重复的分析任务,可使用脚本自动化执行,并通过邮件等方式发送报告,提高工作效率。

Python 数据分析在各行各业都有广泛的应用,以下是几个典型场景。

在电商行业,用 Python 分析用户消费数据,挖掘用户购买行为模式,进行用户分群和精准营销。通过分析商品销售数据,预测销量趋势,优化库存管理。

金融领域利用 Python 进行风险分析,通过对客户信用数据的分析,评估信贷风险;对市场数据进行实时分析,辅助投资决策。

在医疗健康行业,Python 可用于分析患者病历数据和诊疗数据,识别疾病风险因素,优化治疗方案。环境科学领域则通过分析环境监测数据,评估环境质量,预测环境变化趋势。

以鸢尾花数据集为例,通过 Python 分析不同品种的特征差异,可辅助植物学家进行品种分类和识别,这种思路也可推广到其他植物或生物的分类研究中。

学习 Python 数据分析需要理论与实践相结合。初学者可从基础语法入手,掌握 NumPy 和 Pandas 的核心操作,通过实际案例练习加深理解。推荐使用 Jupyter Notebook 进行学习,边学边练,即时查看代码运行结果。

多参与实战项目,尝试解决实际问题。阅读优秀的开源项目代码,学习他人的编程思路和分析方法。同时,关注数据分析领域的最新技术和库更新,持续拓展知识边界。

总之,Python 为数据分析提供了强大而灵活的工具链,掌握用 Python 进行数据分析的技能,能让你在数据驱动的时代更具竞争力。从数据加载到可视化呈现,每一个环节都充满挑战与乐趣,随着实践的深入,你将能运用 Python 挖掘数据背后的价值,为决策提供科学依据。

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-05在数据库数据查询、业务报表统计、多表关联分析中,LEFT JOIN左连接是使用率最高的SQL关联查询语句。其核心特性是保留左表全部数 ...

2026-06-05 很多数据分析师能熟练地写SQL、做透视表、算描述性统计,但当被问到“如何预测用户流失概率”“如何归因销量下滑的关键因素 ...

2026-06-05任何一款产品从诞生、普及到最终退出市场,都会遵循一套固定的发展规律,这就是产品生命周期理论。在市场竞争日益激烈、产品迭代 ...

2026-06-04在Excel数据分析、办公统计、业务报表制作场景中,数据透视表是数据汇总、分类统计、快速复盘的核心工具,能够高效完成海量原始 ...

2026-06-04 很多数据分析师拿到数据就开始清洗、建模,但当被问到“这批数据属于什么类型——结构化还是非结构化?分类变量还是数值变量 ...

2026-06-04在问卷调查与社会科学数据分析中,卡方检验是最常用、最基础的非参数检验方法,广泛应用于市场调研、用户分析、行为统计、满意度 ...

2026-06-03【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-03 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-06-03逻辑回归是数据分析、机器学习、统计建模中应用最广泛的二分类预测模型,常用于风险判断、行为预测、归因分析等场景。在SPSS、Py ...

2026-06-02数字经济时代,市场竞争日趋同质化,用户消费需求愈发个性化、多元化,传统依托经验、粗放式、广撒网的营销模式弊端日益凸显。长 ...

2026-06-02 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-06-02在市场竞争日趋饱和、用户需求不断细分的当下,企业创业创新、产品迭代与市场拓展不再依赖经验决策,而是需要系统化、工具化的商 ...

2026-06-01【核心关键词】调度、岗位、数据库、企业、报表、培训、程序、数据分析、数据加工、业务部门、企业数据、调度工具、业务指标、 ...

2026-06-01 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-06-01在数据统计分析、数据清洗、异常值识别与数据分布研究中,箱型图是最直观、高效、专业的可视化分析工具。相较于柱状图、折线图仅 ...

2026-05-29Tkinter是Python内置的标准GUI图形界面库,具备无需额外安装、调用简单、兼容性强、轻量化高效等优势,是Python快速开发桌面小程 ...

2026-05-29 很多分析师在设计标签时思路清晰,但真到落地环节却面临“数据在手,不知如何转化为可用标签”的困境:或因加工方式选择不当 ...

2026-05-29【核心关键词】大数据、经理、专业、金融、客户、传统、建模、数据产品、互联网金融、产品经理、数据分析、金融行业、数据模型 ...

2026-05-28 很多分析师每天和数据打交道,但当被问到“标签是什么”“标签和指标有什么区别”“标签体系如何设计”时,却常常答不上来。 ...

2026-05-28