京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

t分布、F分布和卡方分布是统计学中常用的三种概率分布,它们分别用于样本均值的推断、方差的比较和数据的拟合优度检验。

总之这3个分布很有用,首次接触你可能理解不了,但没关系你知道很重要就行了,接着往下看,我们在介绍三大分布之前,先看一下正态分布和标准正态分布:

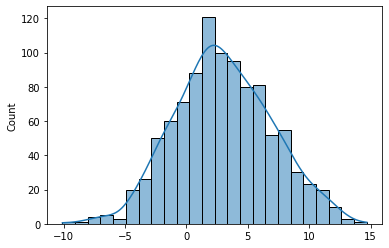

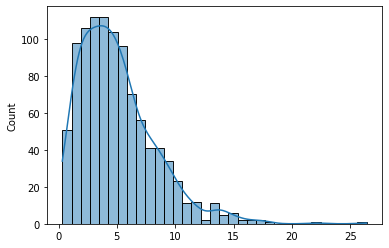

正态分布具有钟形曲线的特征,均值和标准差是其两个重要的参数。

import numpy as np

import seaborn as sns

mean = 3 # 均值

std = 4 # 标准差

size = 1000 # 生成1000个随机数

data = np.random.normal(mean, std, size=size)

sns.histplot(data, kde=True)

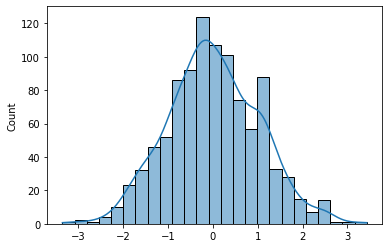

标准正态分布是一种特殊的正态分布,其均值为0,标准差为1。在统计学中,标准正态分布经常用于标准化数据或进行假设检验。

import numpy as np

import seaborn as sns

size = 1000 # 生成1000个随机数

data = np.random.standard_normal(size=size)

sns.histplot(data, kde=True)

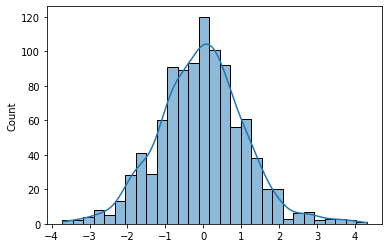

t分布是一种概率分布,用于小样本情况下对总体均值的推断。当样本容量较小或总体方差未知时,使用T分布进行推断更准确。T分布的形状类似于正态分布,但尾部较宽。T分布的自由度(degrees of freedom)决定了其形状。

import numpy as np

import seaborn as sns

df = 10 # 自由度

size = 1000 # 生成1000个随机数

data = np.random.standard_t(df, size=size)

sns.histplot(data, kde=True)

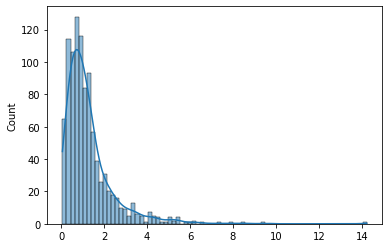

F分布是一种概率分布,用于比较两个样本方差的差异。F分布常用于方差分析和回归分析中。F分布的形状取决于两个自由度参数,分子自由度和分母自由度。

import numpy as np

import seaborn as sns

dfn = 5 # 分子自由度

dfd = 10 # 分母自由度

size = 1000 # 生成1000个随机数

data = np.random.f(dfn, dfd, size=size)

sns.histplot(data, kde=True)

卡方分布是一种概率分布,用于检验观察值与理论值之间的拟合优度。卡方分布常用于拟合优度检验、独立性检验中。卡方分布的自由度参数决定了其形状。

import numpy as np

import seaborn as sns

df = 5 # 自由度

size = 1000 # 生成1000个随机数

data = np.random.chisquare(df, size)

sns.histplot(data, kde=True)

注:本节作为延伸阅读,初学者简单了解即可

十九世纪中叶至二十世纪初,有三位统计学届杰出代表: 皮尔逊( Pearson) 、戈塞特( Gosset) 、费希尔( Fisher) 表,他们是统计学三大分布的始创者。

皮尔逊(Pearson) 在创立拟合优度理论的过程中发现了 分布;

戈塞特( Gosset) 发现 分布的过程正是 小样本理论 创立的过程;

费希尔( Fisher) 在创立 方差分析 理论的过程中发现了 分布。

这便是著名的三大抽样分布包括: 分布、 分布和 分布

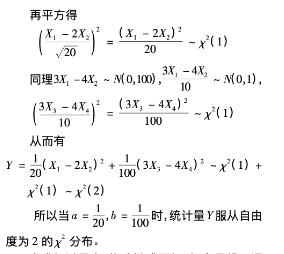

分布是由个相互独立的标准正态分布 的平方和确定的分布,记作 ~ ,即

分布的分子是一个 ,分母是自由度为 的 分布与自由度 的比值再开方确定的分布,记作 ~ ,即

分布是由两个 分布与其自由度比值的比值确定的分布 ,记 作 ~ ,即

三大分布的推导

这里分享一个你一定用得到的小程序——CDA数据分析师考试小程序。

它是专为CDA数据分析认证考试报考打造的一款小程序。可以帮你快速报名考试、查成绩、查证书、查积分,通过该小程序,考生可以享受更便捷的服务。

扫码加入CDA小程序,与圈内考生一同学习、交流、进步!

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在统计学分析、实验研究、业务数据复盘过程中,单因素方差分析是检验自变量对因变量是否存在显著影响的核心方法。其中,两个水平 ...

2026-05-26【核心关键词】算法、客户、大数据、互联网、调优、建模、模型优化、机器学习、评分卡模型、模型开发、智能风控、业务场景、数 ...

2026-05-26 很多数据分析师写过无数个 SELECT,但当被问到“新建一张表,该如何定义字段类型来保证数据质量”“创建视图和存储物理表有 ...

2026-05-26在数据清洗、统计分析与数据质量检测工作中,箱型图(又称箱线图、Box Plot)是最直观、最高效的可视化分析工具之一。相较于柱状 ...

2026-05-25在大数据分析、数据清洗、质量管控、风险监测等领域,异常数据识别是保障数据质量、确保分析结论精准、规避业务决策失误的核心基 ...

2026-05-25 很多数据分析师精通Excel函数和透视表,但当被问到“数据从哪里来”“表和视图有什么区别”“数据库管理系统和SQL是什么关系 ...

2026-05-25数字化经营时代,企业的市场竞争早已从经验决策转向数据决策。门店营收、用户转化、产品销量、成本损耗、存量资产等所有经营行为 ...

2026-05-22在MySQL数据库日常运维、业务数据校验、数据迁移与数据清洗场景中,自增主键ID的连续性校验是一项基础且关键的工作。MySQL的Auto ...

2026-05-22 很多企业团队并非缺乏指标,而是陷入“指标失控”:仪表盘上堆满实时跳动的数据,却无法回答“当前瓶颈在哪、下一步该做什么 ...

2026-05-22【核心关键词】大数据、可视化、存储、架构、客户、离线、产品、同步、实时、数据仓库、数据分析、数据可视化、存储数据、离线 ...

2026-05-21在电商流量红利消退、公域获客成本持续走高的当下,存量用户深度挖掘已成为店铺增收增效的核心抓手。相较于付费投放获取的陌生新 ...

2026-05-21 很多数据分析师每天盯着几十个指标,但当被问到“这套指标要支撑什么业务目标”“指标之间是什么逻辑关系”“业务变化时如何 ...

2026-05-21在数据驱动决策的时代,数据质量直接决定分析结果的可靠性与准确性,而异常值作为数据清洗中的核心痛点,往往会扭曲分析结论、误 ...

2026-05-20 很多数据分析师每天盯着GMV、DAU、转化率,但当被问到“哪些指标在所有行业都适用”“哪些指标只对电商有意义”“二者如何搭 ...

2026-05-20Agent的能力边界,很大程度上取决于其掌握的Skill质量和数量。传统做法是靠人工编写和维护Skill,但这条路很快会遇到瓶颈。业务 ...

2026-05-20在统计分析中,方差分析(ANOVA)是一种常用的假设检验方法,核心用于分析“一个或多个自变量对单个因变量的影响”,广泛应用于 ...

2026-05-19 很多数据分析师每天盯着GMV、DAU、转化率,但当被问到“什么是指标”“指标和维度有什么区别”“如何定义指标值的计算规则和 ...

2026-05-19想高效备考 CDA 一级,拒绝盲目刷题、冗余学习?《CDA 一级教材知识手册》重磅来袭!以官方教材为核心,浓缩 13 章 103 个核心考 ...

2026-05-19在数据统计分析中,卡方检验是一种常用的非参数检验方法,核心用于判断两个或多个分类变量之间是否存在显著关联,广泛应用于市场 ...

2026-05-18在企业数字化转型的浪潮中,很多企业陷入了“技术堆砌”的误区——上线了ERP、CRM、BI等各类系统,积累了海量数据,却依然面临“ ...

2026-05-18