京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

光“大”是不行的,开放才能实现大数据的深发展(2)_数据分析师

三个关于开放的概念

1、数据开放

首先是狭义的数据开放。数据开放的主体是政府和科研机构,把非涉密的政府数据及科研数据开放出来。现在也有一些企业愿意开放数据,像Netflix和一些电信运营商,来帮助他们的数据价值化,建构生态系统。但是数据开放不等于信息公开。首先,数据不等于信息,信息是从数据里面提炼出来的东西。我们希望,首先要开放原始的数据(raw data),其次,它是一种主动和免费的开放,我们现在经常听说要申请信息公开,那是被动的开放。

Tim Berners Lee提出了数据开放的五星标准,以保证数据质量:一星是开放授权的格式,比如说PDF;其次是结构化,把数据从文件变成了像excel这样的表;三星是开放格式,如CSV;四星是能够通过URI找到每一个数据项;五星代表能够和其它数据链接,形成一个开放的数据图谱。

现在主流的数据开放门户,像data.dov或data.gov.uk,都是基于开源软件。英特尔在MIT的大数据科研中心也做了一种形态,叫Datahub:吉祥物很有趣,一半是大象,代表数据库技术,一半是章鱼,取自github的吉祥物章鱼猫。它提供更多的功能比如易管理性,提供结构化数据服务和访问控制,对数据共享进行管理,同时可以在原地做可视化和分析。

广义的数据开放还有数据的共享及交易,比如点对点进行数据共享或在多边平台上做数据交易。马克思说生产资料所有制是经济的基础,但是现在大家可以发现,生产资料的租赁制变成了一种主流(参考《Lean Startup》),在数据的场景下,我不一定拥有数据,甚至不用整个数据集,但可以租赁。租赁的过程中要保证数据的权利。

首先,我可以做到数据给你用,但不可以给你看见。姚期智老先生82年提出“millionaires’ dilemma(百万富翁的窘境)”,两个百万富翁比富谁都不愿意说出自己有多少钱,这就是典型的“可用但不可见”场景。在实际生活中的例子很多,比如美国国土安全部有恐怖分子名单(数据1),航空公司有乘客飞行记录(数据2),国土安全部向航空公司要乘客飞行记录,航空公司不给,因为涉及隐私,他反过来向国土安全部要恐怖分子名单,也不行,因为是国家机密。双方都有发现恐怖分子的意愿,但都不愿给出数据,有没有办法让数据1和数据2放一起扫一下,但又保障数据安全呢?

其次,在数据使用过程中要有审计,万一那个扫描程序偷偷把数据藏起来送回去怎么办?再者,需要数据定价机制,双方数据的价值一定不对等,产生的洞察对各方的用途也不一样,因此要有个定价机制,比大锅饭式的数据共享更有激励性。

从点对点的共享,走到多边的数据交易,从一对多的数据服务到多对多的数据市场,再到数据交易所。如果说现在的数据市场更多是对数据集进行买卖的话,那么数据交易所就是一个基于市场进行价值发现和定价的,像股票交易所那样的、小批量、高频率的数据交易。

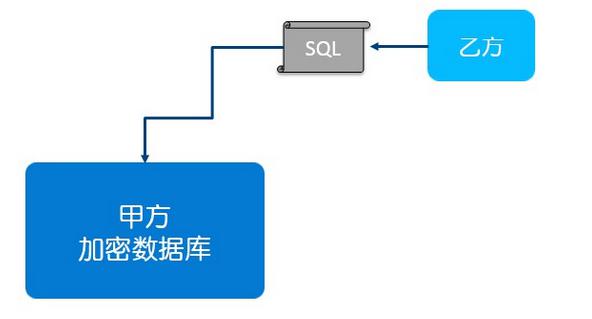

我们支持了不少研究来实现刚才所说的这些功能,比如说可用而不可见。案例一是通过加密数据库CryptDB/Monomi实现,在数据拥有方甲方这边的数据库是完全加密的,这事实上也防止了现在出现的很多数据泄露问题,大家已经听到,比如说某互联网服务提供商的员工偷偷把数据拿出来卖,你的数据一旦加密了他拿出来也没用。其次,这个加密数据库可以运行乙方的普通SQL程序,因为它采用了同态加密技术和洋葱加密法,SQL的一些语义在密文上也可以执行。

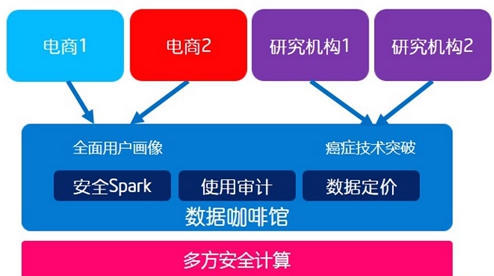

针对“百万富翁的窘境”,我们做了另一种可用但不可见的技术,叫做数据咖啡馆。大家知道咖啡馆是让人和人进行思想碰撞的地方,这个数据咖啡馆就是让数据和数据能够碰撞而产生新的价值。

比如两个电商,一个是卖衣服的,一个是卖化妆品的,他们对于客户的洞察都是相对有限的,如果两边的数据放在一起做一次分析,那么就能够获得全面的用户画像。再如,癌症是一类长尾病症,有太多的基因突变,每个研究机构的基因组样本都相对有限,这在某种程度上解释了为什么过去50年癌症的治愈率仅仅提升了8%。那么,多个研究机构的数据在咖啡馆碰一碰,也能够加速癌症的研究。

在咖啡馆的底层是多方安全计算的技术,基于英特尔和伯克利的一个联合研究。在上面是安全、可信的Spark,基于“data lineage”的使用审计,根据各方数据对结果的贡献进行定价。

2、大数据基础设施的开放

现在有的是有大数据思维的人,但他们很捉急,玩不起、玩不会大数据,他不懂怎么存储、怎么处理这些大数据,这就需要云计算。基础设施的开放还是传统的Platform as a Service,比如Amazon AWS里有MapReduce,Google有Big Query。这些大数据的基础处理和分析平台可以降低数据思维者的门槛,释放他们的创造力。

比如decide.com,每天爬几十万的数据,对价格信息(结构化的和非结构化的)进行分析,然后告诉你买什么牌子、什么时候买最好。只有四个PhD搞算法,其他的靠AWS。另一家公司Prismatic,也利用了AWS,这是一家做个性化阅读推荐的,我专门研究过它的计算图、存储和高性能库,用LISP的一个变种Clojure写的非常漂亮,真正做技术的只有三个学生。

所以当这些基础设施社会化以后,大数据思维者的春天很快就要到来。

3、价值提取能力的开放

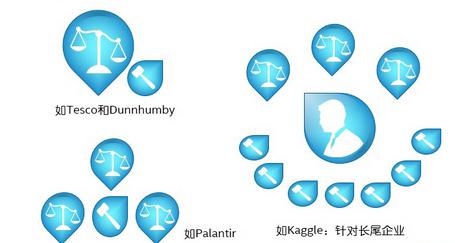

现在的模式一般是一大一小或一对多。比如Tesco和Dunnhumby,后者刚开始是很小的公司,找到Tesco给它做客户忠诚度计划,一做就做了几十年,这样的长期战略合作优于短期的数据分析服务,决策更注重长期性。当然,Dunnhumby现在已经不是小公司了,也为其他大公司提供数据分析服务。再如沃尔玛和另外一家小公司合作,做数据分析,最后他把这家小公司买下来了,成了它的Walmart Labs。

一对多的模式,典型的是Palantir——Peter Thiel和斯坦福的几个教授成立的公司,目前还是私有的,但估值近百亿了,它很擅长给各类政府和金融机构提供数据价值提取服务。真正把这种能力开放的是Kaggle,它的双边,一边是10多万的分析师,另一边是需求方企业,企业在Kaggle上发标,分析师竞标,获得业务。这可能是真正解决长尾公司价值提取能力的办法。当然,如果能和我们的数据咖啡馆结合,就更好了。

CDA学员免费下载查看报告全文:2026全球数智化人才指数报告【CDA数据科学研究院】.pdf

CDA学员免费下载查看报告全文:2026全球数智化人才指数报告【CDA数据科学研究院】.pdf

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

用户调研是企业洞察客户需求、优化产品服务、制定运营策略的核心前提,而调研数据的可靠性,直接决定了决策的科学性与有效性。在 ...

2026-05-11在市场竞争日趋激烈、流量成本持续攀升的今天,企业的核心竞争力已从“获取流量”转向“挖掘客户价值”。客户作为企业最宝贵的资 ...

2026-05-11 很多数据分析师精通Excel单元格操作,熟练应用多种公式,但当被问到“表结构数据的基本处理单位是什么”“字段和记录的本质 ...

2026-05-11在互联网运营、产品优化、用户增长等领域,次日留存率是衡量产品价值、用户粘性与运营效果的核心指标,更是判断新用户是否认可产 ...

2026-05-09相关性分析是数据分析领域中用于探究两个或多个变量之间关联强度与方向的核心方法,广泛应用于科研探索、商业决策、医疗研究、社 ...

2026-05-09 数据分析师八成以上的时间在和数据表格打交道,但许多人拿到Excel后习惯性地先算、先分析,结果回头发现漏了一列关键数据, ...

2026-05-09在数据驱动运营的时代,指标是连接业务目标与实际行动的核心桥梁,是企业解读业务现状、发现问题、预判趋势的“量化标尺”。一套 ...

2026-05-08在存量竞争日趋激烈的商业时代,“以客户为中心”早已从口号落地为企业运营的核心逻辑。而客户画像作为打通“了解客户”与“服务 ...

2026-05-08 很多数据分析师每天与Excel打交道,但当被问到“什么是表格结构数据”“它和表结构数据有什么区别”“表格结构数据有哪些核 ...

2026-05-08在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-05-07在数字化时代,商业竞争的核心已从“经验驱动”转向“数据驱动”,越来越多的企业意识到,商业分析不是简单的数据统计与报表呈现 ...

2026-05-06在Excel数据透视表的实操中,“引用”是连接透视表与公式、辅助数据的核心操作,而相对引用作为最基础、最常用的引用方式,其设 ...

2026-05-06 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-05-06在Excel数据分析中,数据透视表是汇总、整理海量数据的高效工具,而公式则是实现数据二次计算、逻辑判断的核心功能。实际操作中 ...

2026-04-30Excel透视图是数据分析中不可或缺的工具,它能将透视表中的数据快速可视化,帮助我们直观捕捉数据规律、呈现分析结果。但在实际 ...

2026-04-30 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-04-30在中介效应分析中,人口统计学变量(如年龄、性别、学历、收入、职业等)是常见的控制变量或调节变量,其处理方式直接影响分析结 ...

2026-04-29在SQL数据库实操中,日期数据的存储与显示是高频需求,而“数字日期”(如20240520、20241231、45321)是很多开发者、数据分析师 ...

2026-04-29