京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

说明

随机森林是另一类可用的集成学习方法,该算法在训练过程中将产生多棵决策树,每棵决策树会根据输入数据集产生相应的预测输出,算法采用投票机制选择类别众数做为预测结果。

操作

导入随机森林包:

library(randomForest)

使用随机森林分类器处理训练数据:

churn.rf = randomForest(churn ~ .,data = trainset,importance = T)

churn.rf

Call:

randomForest(formula = churn ~ ., data = trainset, importance = T)

Type of random forest: classification

Number of trees: 500

No. of variables tried at each split: 4

OOB estimate of error rate: 5.27%

Confusion matrix:

yes no class.error

yes 245 97 0.28362573

no 25 1948 0.01267106

利用训练好的模型对测试集进行分类预测:

churn.prediction = predict(churn.rf,testset)

类似其它分类处理,产生分类表:

table(churn.prediction,testset$churn)

churn.prediction yes no

yes 111 7

no 30 870

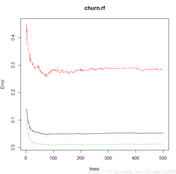

调用plot函数绘制森林对象均方差:

plot(churn.rf)

随机森林的均方差

根据建立好的模型评估各属性的重要度:

importance(churn.rf)

yes no MeanDecreaseAccuracy MeanDecreaseGini

international_plan 68.9592890 54.118994 72.190204 50.35584

voice_mail_plan 18.8899994 15.832400 19.607844 10.44601

number_vmail_messages 21.3080062 16.262770 22.068514 19.05619

total_day_minutes 28.3237379 30.323756 39.961077 79.91474

total_day_calls 0.6325725 -1.131930 -0.802642 20.80946

total_day_charge 28.4798708 28.146414 35.858906 77.84837

total_eve_minutes 18.5242988 20.572464 24.484322 42.99373

total_eve_calls -3.3431379 -2.301767 -3.495801 17.45619

total_eve_charge 20.4379809 20.619705 24.489771 44.02855

total_night_minutes 0.9451961 16.105720 16.694651 22.93663

total_night_calls -0.3497164 2.202619 1.869193 19.94091

total_night_charge 0.1110824 15.977083 16.593633 22.22769

total_intl_minutes 17.3951655 20.063485 24.967698 26.05059

total_intl_calls 37.3613313 23.415764 35.497785 33.03289

total_intl_charge 16.7925666 19.636891 24.498369 26.60077

number_customer_service_calls 79.7530696 59.731615 85.221845 67.29635

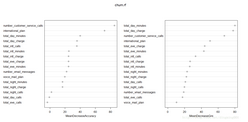

调用varlmPlot函数绘制变量重要性曲线

varImpPlot(churn.rf)

变量重要性示例

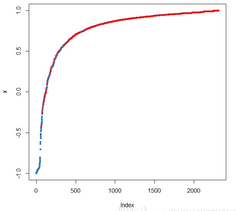

调用margin及plot函数并绘制边缘累计分布图:

margins.rf = margin(churn.rf,trainset)

plot(margins.rf)

随机森林算法边缘累积分布图

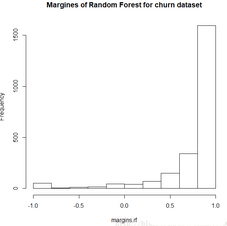

还可以用直方图来绘制随机森林的边缘分布:

hist(margins.rf,main = "Margines of Random Forest for churn dataset")

边缘分布直方图

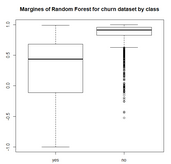

调用boxplot绘制随机森林各类别边缘的箱线图

boxplot(margins.rf ~ trainset$churn,main = "Margines of Random Forest for churn dataset by class")

随机森林类别边缘箱图

原理:

随机森林算法目标是通过将多个弱学习机(如单棵决策树)组合得到一个强学习机,算法的处理过程与bagging方法非常相似,假设当拥有N个特征数为M的样例,首先采用bootstrap对数据集进行采样,每次随机采样N个样本作为单个决策树的训练数据集。在每个节点,算法首先随机选取m(m << M)个变量,从它们中间找到能够提供最佳分割效果的预测属性。

然后,算法在不剪枝的前提下生成单颗决策树,最后从每个决策树都得到一个分类预测结果。

如果是回归分析,算法将取所有预测的平均值或者加权平均值作为最后刚出,如果是分类问题,则选择类别预测众数做为最终预测输出。

随机森林包括两个参数,ntree(决策树个数)和mtry(可用来寻找最佳特征的特征个数),而bagging算法只使用了一个ntree参数,因此,如果将mtry设置成与训练数据集特征值一样大时,随机森林算法就等同于bagging算法。

本例利用randomForest包提供的随机森林算法建立了分类模型,将importance值设置为“T”,以确保对预测器的重要性进行评估。

与bagging和boosting方法类似,一旦随机森林的模型构建完成,我们就能利用其对测试数据集进行预测,并得到相应的分类表。

randomForest包还提供了importance和varlmpPlot函数则可以通过绘制平均精确度下降或者平均基尼下降曲线实现属性重要性的可视化。

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在手游行业竞争日趋白热化的当下,“流量为王”早已升级为“留存为王”,而付费用户留存率更是衡量一款手游盈利能力、运营质量的 ...

2026-04-28在日常MySQL数据库运维与开发中,经常会遇到“同一台服务器上,两个不同数据库(以下简称“源库”“目标库”)的表数据需要保持 ...

2026-04-28 很多分析师每天和数据打交道,但当被问到“标签是什么”“标签和指标有什么区别”“标签体系如何设计”时,却常常答不上来。 ...

2026-04-28箱线图(Box Plot)作为一种经典的数据可视化工具,广泛应用于统计学、数据分析、科研实证等领域,核心价值在于直观呈现数据的集 ...

2026-04-27实证分析是社会科学、自然科学、经济管理等领域开展研究的核心范式,其核心逻辑是通过对多维度数据的收集、分析与解读,揭示变量 ...

2026-04-27 很多数据分析师精通Excel函数和数据透视表,但当被问到“数据从哪里来”“表和视图有什么区别”“数据库管理系统和SQL是什么 ...

2026-04-27在大数据技术飞速迭代、数字营销竞争日趋激烈的今天,“精准触达、高效转化、成本可控”已成为企业营销的核心诉求。传统广告投放 ...

2026-04-24在游戏行业竞争白热化的当下,用户流失已成为制约游戏生命周期、影响营收增长的核心痛点。据行业报告显示,2024年移动游戏平均次 ...

2026-04-24 很多业务负责人开会常说“我们要数据驱动”,最后却变成“看哪张报表数据多就用哪个”,往往因为缺乏一套结构性的方法去搭建 ...

2026-04-24在Power BI数据可视化分析中,切片器是连接用户与数据的核心交互工具,其核心价值在于帮助使用者快速筛选目标数据、聚焦分析重点 ...

2026-04-23以数为据,以析促优——数据分析结果指导临床技术改进的实践路径 临床技术是医疗服务的核心载体,其水平直接决定患者诊疗效果、 ...

2026-04-23很多数据分析师每天盯着GMV、DAU、转化率,但当被问到“哪些指标是所有企业都需要的”“哪些指标是因行业而异的”“北极星指标和 ...

2026-04-23近日,由 CDA 数据科学研究院重磅发布的《2026 全球数智化人才指数报告》,被中国教育科学研究院官方账号正式收录, ...

2026-04-22在数字化时代,客户每一次点击、浏览、下单、咨询等行为,都在传递其潜在需求与决策倾向——这些按时间顺序串联的行为轨迹,构成 ...

2026-04-22数据是数据分析、建模与业务决策的核心基石,而“数据清洗”作为数据预处理的核心环节,是打通数据从“原始杂乱”到“干净可用” ...

2026-04-22 很多数据分析师每天盯着GMV、转化率、DAU等数字看,但当被问到“什么是指标”“指标和维度有什么区别”“如何搭建一套完整的 ...

2026-04-22在数据分析与业务决策中,数据并非静止不变的数值,而是始终处于动态波动之中——股市收盘价的每日涨跌、企业月度销售额的起伏、 ...

2026-04-21在数据分析领域,当研究涉及多个自变量与多个因变量之间的复杂关联时,多变量一般线性分析(Multivariate General Linear Analys ...

2026-04-21很多数据分析师精通描述性统计,能熟练计算均值、中位数、标准差,但当被问到“用500个样本如何推断10万用户的真实满意度”“这 ...

2026-04-21在数据处理与分析的全流程中,日期数据是贯穿业务场景的核心维度之一——无论是业务报表统计、用户行为追踪,还是风控规则落地、 ...

2026-04-20