京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

如何看穿数据可视化的谎言

以前我们看到一个做得很烂的图表,或者穿帮的数据可视化作品时,往往是将它们嘲笑一番也就算了。但有些时候,尤其是刚过去的这一年,我们好像更难分辨一个可视化作品是单纯的糟糕产物,还是出于偏见而刻意制造的虚假信息。

当然,用数据来撒谎已经不是什么新鲜事儿了,但现在图表越来越容易被广泛传播,网上到处都是,而其中好多传递的是假象。你可能只是随便瞟了一眼,但一个简单的信息也可能在脑子里生根发芽。在你还不知道的时候,小李子已经在桌子上转起了陀螺,而没人关心它会停下来还是会一直转下去。

自然而然地,现在我们需要快速看穿一个图表是否在撒谎,而这篇图文就是你贴心的指导手册哟。

1)截断数轴

左边的y轴数据从10开始,纯粹的瞎话。右边的数据从0开始,很好。长度是柱状图视觉呈现的关键,所以当某些人通过截断数轴而故意把长度缩短时,整个图表的差别就变得更明显了。这些人想要展现出比实际情况更剧烈的变化。我在另一篇文章里详细谈了这个问题。

2)双重数轴

它用了两种差距极大的比例,可能是为了强行扯上因果关系。通过使用双重数轴,数据的量级可以根据两种度量来缩小或扩张。人们通常用它来表达相关度和因果关系。“因为这个东东,另一个事儿发生了,看,很清楚吧。”

Tyler Vigen做的假相关数据的项目是个极好的例子。

3)总和不对头

饼图中所有部分的比例加起来超过了100%。一些图表专门要展示总体中的某些部分,而当这些部分加起来超过了总和,问题就很大了。比如,饼图代表的是总共100%,而如果每个扇形的比例加起来超过了100%?怪怪的噢。

可以看看这个搞笑的例子。

4)只看绝对值

这其实只是人口分布图。当你对比不同地方、种类或群体时,你必须考虑相对值,公平比较任何事物都是相对的。你不能因为某个城镇发生了两起抢劫案,另一个只发生了一起,就说第一个镇更危险。万一第一个镇的人口是第二个的一千倍呢?更有效的方式往往是对比百分数和比例,而非绝对值和总值。

这幅xkcd的漫画很直白地展现了人口绝对数的影响。

5)有限范围

左图看上去增幅很大,但右图显示出这只是常态,且选定时间内的增幅实际并不明显。人们倾向于精心挑选日期和时间段来配合特定的叙事,所以更应该考虑到历史背景、时常发生的事件,以及合理的用来比较的基准。

当你研究全局时,可能会发现有趣的事情。

6)奇怪的分级

左图只有两个分级,大于1的究竟包括些什么?可能在打掩护。右图更好,展示了更多变量有些可视化作品会过分简化一个复杂的模型,而非展示出原数据中完整的变量范围。这样做很容易会把一个连续的变量转化为从属于某一类别的变量。

广泛的分级在某些情况下很有用,但复杂性往往才是事物的意义所在。要防止过分简化。

7)混乱的面积比

30是10的三倍,但或许是为了增加显著性,图上最大的矩形比最小的大得可不止三倍。如果按照面积来进行视觉上的编码,图形的大小比例就该是面积的比例。有些人却在做面积编码的可视化时,改变边长的比例来突出大小对比,完全是为了抓马啊。

有时这种错误是无意间造成的,更需要警觉。

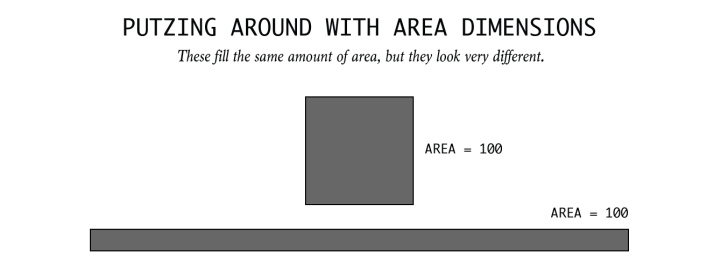

8)操控面积维度

上下两个图形的面积相等,但看上去很不一样。或许有人懂得怎么用面积来做视觉编码,却还(gu)是(yi)做出了上图这样的东西。我还没见过如此夸张的例子,但以后说不定就会有。我打赌连象形图都能出现,等着瞧吧。

上下两个图形的面积相等,但看上去很不一样。或许有人懂得怎么用面积来做视觉编码,却还(gu)是(yi)做出了上图这样的东西。我还没见过如此夸张的例子,但以后说不定就会有。我打赌连象形图都能出现,等着瞧吧。

9)为了三维而三维

千万别。当你看到一个明明没必要还强行用三维的图表,请质疑它的数据、图表、作者及图表衍生出的任何事物。

划重点:如果一个可视化作品出现了以上任何问题,并不代表它一定在撒谎。正如Darrell Huff在《如何用数据撒谎》里说的:

“本书的标题和里面一些内容可能像是在说,所有类似的作品都是为欺骗而生的产物。美国统计协会一个分会的主席曾经因为这个批评我,他觉得与其说出于欺骗,倒更像是能力不足。”

当然,这并不等于就可以原谅,毕竟也做错了嘛。但记住这点,你在骂某某某是骗子之前就可以再考虑考虑。

我的经验是,仔细检查那些令人震惊的、比想象中更具戏剧性的图表。

图表并不能让虚假的信息变成真的,数据也不能。它们会屈从于做图的人,也展示出信息本身之外更多的东西。那么,睁大你的眼睛咯。

CDA学员免费下载查看报告全文:2026全球数智化人才指数报告【CDA数据科学研究院】.pdf

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在互联网运营、产品优化、用户增长等领域,次日留存率是衡量产品价值、用户粘性与运营效果的核心指标,更是判断新用户是否认可产 ...

2026-05-09相关性分析是数据分析领域中用于探究两个或多个变量之间关联强度与方向的核心方法,广泛应用于科研探索、商业决策、医疗研究、社 ...

2026-05-09 数据分析师八成以上的时间在和数据表格打交道,但许多人拿到Excel后习惯性地先算、先分析,结果回头发现漏了一列关键数据, ...

2026-05-09在数据驱动运营的时代,指标是连接业务目标与实际行动的核心桥梁,是企业解读业务现状、发现问题、预判趋势的“量化标尺”。一套 ...

2026-05-08在存量竞争日趋激烈的商业时代,“以客户为中心”早已从口号落地为企业运营的核心逻辑。而客户画像作为打通“了解客户”与“服务 ...

2026-05-08 很多数据分析师每天与Excel打交道,但当被问到“什么是表格结构数据”“它和表结构数据有什么区别”“表格结构数据有哪些核 ...

2026-05-08在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-05-07在数字化时代,商业竞争的核心已从“经验驱动”转向“数据驱动”,越来越多的企业意识到,商业分析不是简单的数据统计与报表呈现 ...

2026-05-06在Excel数据透视表的实操中,“引用”是连接透视表与公式、辅助数据的核心操作,而相对引用作为最基础、最常用的引用方式,其设 ...

2026-05-06 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-05-06在Excel数据分析中,数据透视表是汇总、整理海量数据的高效工具,而公式则是实现数据二次计算、逻辑判断的核心功能。实际操作中 ...

2026-04-30Excel透视图是数据分析中不可或缺的工具,它能将透视表中的数据快速可视化,帮助我们直观捕捉数据规律、呈现分析结果。但在实际 ...

2026-04-30 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-04-30在中介效应分析中,人口统计学变量(如年龄、性别、学历、收入、职业等)是常见的控制变量或调节变量,其处理方式直接影响分析结 ...

2026-04-29在SQL数据库实操中,日期数据的存储与显示是高频需求,而“数字日期”(如20240520、20241231、45321)是很多开发者、数据分析师 ...

2026-04-29 很多分析师在设计标签时思路清晰,但真到落地环节却面临“数据在手,不知如何转化为可用标签”的困境:或因加工方式选择不当 ...

2026-04-29在手游行业竞争日趋白热化的当下,“流量为王”早已升级为“留存为王”,而付费用户留存率更是衡量一款手游盈利能力、运营质量的 ...

2026-04-28在日常MySQL数据库运维与开发中,经常会遇到“同一台服务器上,两个不同数据库(以下简称“源库”“目标库”)的表数据需要保持 ...

2026-04-28