京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

cd /opt/linuxsir

tar -zxvf hadoop-2.7.3.tar.gz

ls

mv hadoop-2.7.3 /opt/linuxsir/hadoop

在192.168.31.131虚拟机上编辑/root/.bashrc文件,然后复制到192.168.31.132、192.168.31.133

echo "" >> /root/.bashrc

echo "export HADOOP_PREFIX=/opt/linuxsir/hadoop" >> /root/.bashrc

echo "export HADOOP_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_COMMON_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_CONF_DIR=$HADOOP_PREFIX/etc/hadoop" >> /root/.bashrc

echo "export HADOOP_HDFS_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_MAPRED_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_YARN_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export PATH=$PATH:$HADOOP_PREFIX/sbin:$HADOOP_PREFIX/bin" >> /root/.bashrc

echo "export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib/native"" >> /root/.bashrc

echo "export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native" >> /root/.bashrc

echo "export CLASSPATH=$CLASSPATH:/opt/linuxsir/hadoop/lib/*" >> /root/.bashrc

cat /root/.bashrc

\在192.168.31.131上,复制/root/.bashrc到132和133

scp -r /root/.bashrc root@192.168.31.132:/root/.bashrc

scp -r /root/.bashrc root@192.168.31.133:/root/.bashrc

\在192.168.31.131上,在131/132/133三台机器上运行/root/.bashrc,刷新环境

cd

source /root/.bashrc

ssh root@192.168.31.132 source /root/.bashrc

ssh root@192.168.31.133 source /root/.bashrc

cd /opt/linuxsir/hadoop \进入/opt/linuxsir/hadoop目录

rm -rf /opt/linuxsir/hadoop/tmp

rm -rf /opt/linuxsir/hadoop/hdfs

mkdir /opt/linuxsir/hadoop/tmp \创建tmp目录

mkdir -p /opt/linuxsir/hadoop/hdfs/data /opt/linuxsir/hadoop/hdfs/name \创建hdfs的data、name子目录

\还要针对hd-slave1,hd-slave2等两个节点上执行上述命令,然后再初始化hdfs

ssh root@192.168.31.132 rm -rf /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.132 rm -rf /opt/linuxsir/hadoop/hdfs

ssh root@192.168.31.132 mkdir /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.132 mkdir -p /opt/linuxsir/hadoop/hdfs/data /opt/linuxsir/hadoop/hdfs/name

ssh root@192.168.31.133 rm -rf /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.133 rm -rf /opt/linuxsir/hadoop/hdfs

ssh root@192.168.31.133 mkdir /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.133 mkdir -p /opt/linuxsir/hadoop/hdfs/data /opt/linuxsir/hadoop/hdfs/name

对若干配置文件进行设置,保证Hadoop能够正常启动。

(1) 主要的配置文件包括HADOOP_HOME目录下的

(2) 并且为如下文件配置环境变量

(3)master和slave

编辑/opt/linuxsir/hadoop/etc/hadoop目录下的core-site.xml文件

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:///opt/linuxsir/hadoop/tmp</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hd-master:9000</value><!-- NameNode URI -->

</property>

<property>

<name>io.file.buffer.size</name>

<value>131702</value>

</property>

</configuration>

编辑/opt/linuxsir/hadoop/etc/hadoop目录下的hdfs-site.xml文件,内容如下

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///opt/linuxsir/hadoop/hdfs/name</value> <!-- 本机name目录for NameNode -->

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///opt/linuxsir/hadoop/hdfs/data</value> <!-- 本机data目录for DataNode -->

</property>

<property>

<name>dfs.replication</name> <!-- 数据块副本数量 -->

<value>2</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hd-master:9001</value>

</property>

</configuration>

在/opt/linuxsir/hadoop/etc/hadoop目录下,复制mapred-site.xml.template到mapred-site.xml,并且进行编辑

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value> <!--yarn or yarn-tez-->

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>hd-master:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hd-master:19888</value>

</property>

<property>

<name>mapreduce.map.memory.mb</name> <!-- memory for map task -->

<value>64</value>

</property>

<property>

<name>mapreduce.reduce.memory.mb</name> <!-- memory for reduce task -->

<value>128</value>

</property>

<property>

<name>mapreduce.task.io.sort.mb</name>

<value>32</value>

</property>

<property>

<name>mapreduce.map.java.opts</name> <!-- settings for JVM map task -->

<value>-Xms128m -Xmx256m</value>

</property>

<property>

<name>mapreduce.reduce.java.opts</name> <!-- settings for JVM reduce task -->

<value>-Xms128m -Xmx256m</value>

</property>

</configuration>

在/opt/linuxsir/hadoop/etc/hadoop编辑yarn-site.xml文件,对YARN资源管理器的ResourceManager和NodeManagers节点、端口、内存分配等进行配置

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hd-master</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>hd-master:9032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>hd-master:9030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>hd-master:9031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>hd-master:9033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>hd-master:9099</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.app.mapreduce.am.resource.mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.app.mapreduce.am.command-opts</name>

<value>-Xms128m -Xmx256m</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>8</value>

</property>

<property>

<name>yarn.nodemanager.resource.cpu-vcores</name>

<value>1</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

</configuration>

进入hadoop-env.sh脚本文件所在目录/opt/linuxsir/hadoop/etc/Hadoop

export JAVA_HOME=/opt/linuxsir/java/jdk

接着,设置/opt/linuxsir/hadoop/etc/hadoop目录下yarn-env.sh脚本文件的JAVA_HOME变量,内容如下

export JAVA_HOME=/opt/linuxsir/java/jdk

如果NodeManager因为内存不足,而启动不起来,那么yarn-env.sh文件需要做如下修改,即JAVA_HEAP_MAX改为3G

JAVA_HEAP_MAX=-Xmx3072m

修改/opt/linuxsir/hadoop/etc/hadoop/masters文件和/opt/linuxsir/hadoop/etc/hadoop/slaves文件,目的是指定主节点和从节点列表。

/opt/linuxsir/hadoop/etc/hadoop/masters文件的内容如下,即主节点为hd-master

hd-master

/opt/linuxsir/hadoop/etc/hadoop/slaves文件的内容如下,即从节点为hd-slave1和hd-slave2

hd-slave1

hd-slave2

从192.168.31.131虚拟机复制Hadoop到其它各个节点,包括192.168.31.132、192.168.31.133。 在192.168.31.131上运行如下命令

chmod a+rwx -R /opt/linuxsir \设置/opt/linuxsir的存取权限

ssh root@192.168.31.132 chmod a+rwx -R /opt/linuxsir

ssh root@192.168.31.133 chmod a+rwx -R /opt/linuxsir

scp -r /root/.bashrc root@192.168.31.132:/root/.bashrc \复制/root/.bashrc

scp -r /root/.bashrc root@192.168.31.133:/root/.bashrc

scp -r /opt/linuxsir/hadoop hd-slave1:/opt/linuxsir \复制/opt/linuxsir/hadoop

scp -r /opt/linuxsir/hadoop hd-slave2:/opt/linuxsir

source ~/.bashrc \刷新环境变量

ssh root@192.168.31.132 source ~/.bashrc

ssh root@192.168.31.133 source ~/.bashrc

这里分享一个你一定用得到的小程序——CDA数据分析师考试小程序。

它是专为CDA数据分析认证考试报考打造的一款小程序。可以帮你快速报名考试、查成绩、查证书、查积分,通过该小程序,考生可以享受更便捷的服务。

扫码加入CDA小程序,与圈内考生一同学习、交流、进步!

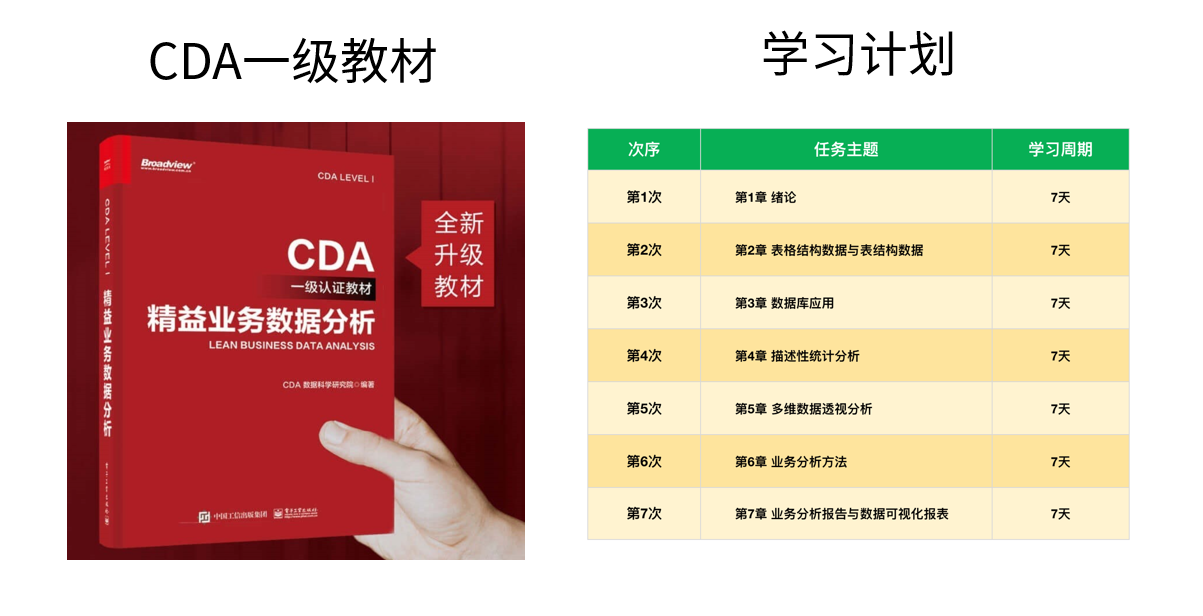

《CDA一级教材》适合CDA一级考生备考,也适合业务及数据分析岗位的从业者提升自我。完整电子版已上线CDA网校,累计已有10万+在读~

免费加入阅读:https://edu.cda.cn/goods/show/3151?targetId=5147&preview=0

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在数字财务、智慧财税、业财融合深度推进的当下,传统财务模式下数据标准混乱、业务流程碎片化、知识无法沉淀、系统互通性差等问 ...

2026-06-08随着数字经济深度渗透各行各业,数据正式成为继土地、劳动力、资本、技术之后的第五大生产要素,是企业数字化转型、精细化运营、 ...

2026-06-08 很多数据分析师能熟练写SQL、做透视表,但当被问到“数据是从哪里来的?经过哪些加工才进入数据仓库?ETL具体做了什么?”时 ...

2026-06-08【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-05在数据库数据查询、业务报表统计、多表关联分析中,LEFT JOIN左连接是使用率最高的SQL关联查询语句。其核心特性是保留左表全部数 ...

2026-06-05 很多数据分析师能熟练地写SQL、做透视表、算描述性统计,但当被问到“如何预测用户流失概率”“如何归因销量下滑的关键因素 ...

2026-06-05任何一款产品从诞生、普及到最终退出市场,都会遵循一套固定的发展规律,这就是产品生命周期理论。在市场竞争日益激烈、产品迭代 ...

2026-06-04在Excel数据分析、办公统计、业务报表制作场景中,数据透视表是数据汇总、分类统计、快速复盘的核心工具,能够高效完成海量原始 ...

2026-06-04 很多数据分析师拿到数据就开始清洗、建模,但当被问到“这批数据属于什么类型——结构化还是非结构化?分类变量还是数值变量 ...

2026-06-04在问卷调查与社会科学数据分析中,卡方检验是最常用、最基础的非参数检验方法,广泛应用于市场调研、用户分析、行为统计、满意度 ...

2026-06-03【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-03 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-06-03逻辑回归是数据分析、机器学习、统计建模中应用最广泛的二分类预测模型,常用于风险判断、行为预测、归因分析等场景。在SPSS、Py ...

2026-06-02数字经济时代,市场竞争日趋同质化,用户消费需求愈发个性化、多元化,传统依托经验、粗放式、广撒网的营销模式弊端日益凸显。长 ...

2026-06-02 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-06-02在市场竞争日趋饱和、用户需求不断细分的当下,企业创业创新、产品迭代与市场拓展不再依赖经验决策,而是需要系统化、工具化的商 ...

2026-06-01【核心关键词】调度、岗位、数据库、企业、报表、培训、程序、数据分析、数据加工、业务部门、企业数据、调度工具、业务指标、 ...

2026-06-01 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-06-01在数据统计分析、数据清洗、异常值识别与数据分布研究中,箱型图是最直观、高效、专业的可视化分析工具。相较于柱状图、折线图仅 ...

2026-05-29Tkinter是Python内置的标准GUI图形界面库,具备无需额外安装、调用简单、兼容性强、轻量化高效等优势,是Python快速开发桌面小程 ...

2026-05-29