京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

作者:俊欣

来源:关于数据分析与可视化

在数据可视化图表中,词云图的应用随处可见。它通常是对输入的一段文字进行词频提取,然后以根据词汇出现频率的大小集中显示高频词,简洁直观高效,今天小编就来分享一下在Python如何绘制出来精湛的词云图。

我们先来尝试绘制一张简单的词云图,用到的Python当中的wordcloud模块来绘制,

import jieba

from wordcloud import WordCloud import matplotlib.pyplot as plt

我们导入文本内容,并且去除掉一下换行符和空格,代码如下

text = open(r"明朝那些事儿.txt",encoding='utf8').read()

text = text.replace('n',"").replace("u3000","")

我们需要将其分成一个个的词,这个时候就需要用到jieba模块了,代码如下

text_cut = jieba.lcut(text) # 将分好的词用某个符号分割开连成字符串 text_cut = ' '.join(text_cut)

当然了,得到的结果当中或许存在着不少我们不需要看的、无关紧要的内容,这个时候就需要用到停用词了,我们可以自己来构建,也可以直接使用别人已经构建好的停词表,这里小编采用的是后者,代码如下

stop_words = open(r"常见中文停用词表.txt").read().split("n")

下面便是绘制词云图的核心代码了

word_cloud = WordCloud(font_path="simsun.ttc", # 设置词云字体 background_color="white", # 词云图的背景颜色 stopwords=stop_words) # 去掉的停词 word_cloud.generate(text_cut)

word_cloud.to_file("1.png")

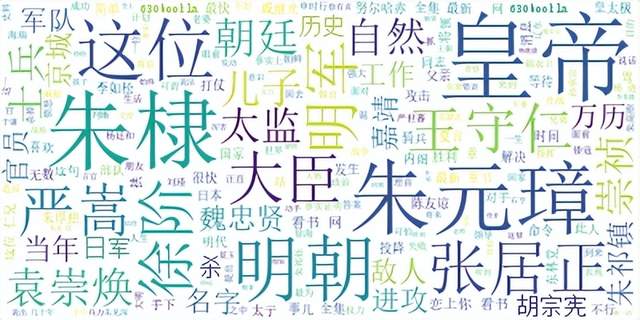

output

这样一张极其简单的词云图算是做好了,当然我们可以给它添加一个背景图片,例如下面这张图片,

主要需要添加的代码如下所示

background = Image.open(r"5.png")

graph = np.array(background)

然后在WorCloud当中添加mask参数

# 使用WordCloud生成词云 word_cloud = WordCloud(font_path="simsun.ttc", # 设置词云字体 background_color="white", # 词云图的背景颜色 stopwords=stop_words, # 去掉的停词 mask=graph)

word_cloud.generate(text_cut)

word_cloud.to_file("1.png")

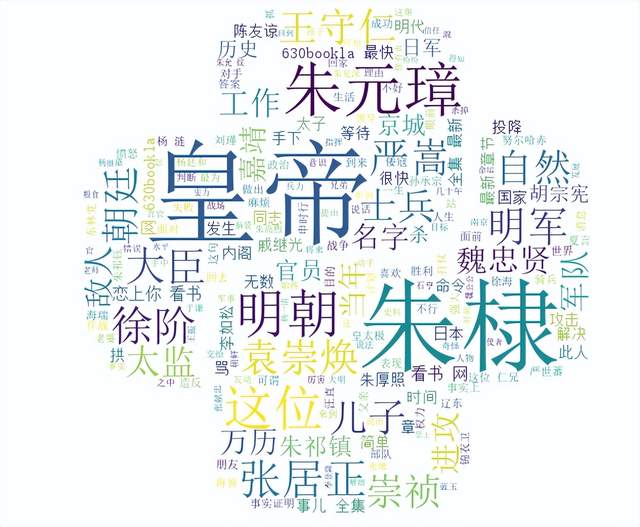

output

除此之外,还有另外一个模块stylecloud绘制出来的词云图也是非常酷炫的,其中我们主要是用到下面这个函数

gen_stylecloud(text=None, icon_name='fas fa-flag', colors=None, palette='cartocolors.qualitative.Bold_5', background_color="white", max_font_size=200, max_words=2000, stopwords=True, custom_stopwords=STOPWORDS, output_name='stylecloud.png', )

其中几个常用的参数有

我们来尝试绘制一个词云图,代码如下

stylecloud.gen_stylecloud(text=text_cut,

palette='tableau.BlueRed_6',

icon_name='fas fa-apple-alt',

font_path=r'田英章楷书3500字.ttf',

output_name='2.png',

stopwords=True,

custom_stopwords=stop_words)

output

其中的palette参数作为调色板,可以任意变换的,具体参考:https://jiffyclub.github.io/palettable/ 这个网站。

最后我们来看一下如何用Pyecharts模块来进行词云图的绘制,代码如下

from pyecharts import options as opts

from pyecharts.charts import Page, WordCloud

words = [

("皇帝", 10000),

("朱元璋", 6181),

("明朝", 4386),

("朝廷", 4055),

("明军", 2467),

("士兵", 2244),

("张居正", 1868),

("王守仁", 1281)

] c = ( WordCloud()

.add("", words, word_size_range=[20, 100])

.set_global_opts(title_opts=opts.TitleOpts(title="基本示例"))

) c.render("1.html")

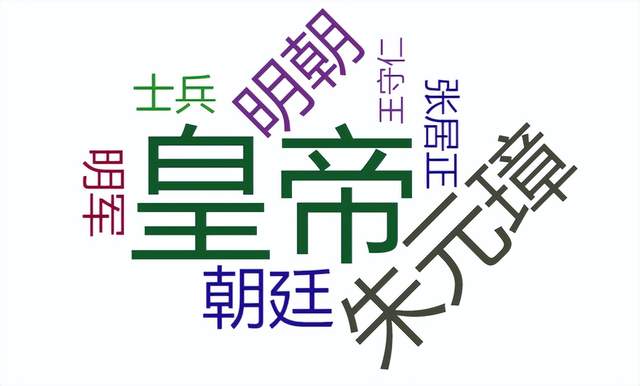

output

出来的结果略显简单了,不过这里值得注意的是,pyecharts当中的WordCloud()方法传入的数据是指定的词语以及其出现的频次,这个和之前的操作有所不同

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

【专访摘要】本次CDA持证专访邀请到拥有丰富物流供应链数据分析经验的赖尧,他结合自身在京东、华莱士、兰格赛等企业的从业经历 ...

2026-05-15在数字化时代,企业的每一次业务优化、每一项技术迭代,都需要回答一个核心问题:这个动作到底能带来多少价值?是提升了用户转化 ...

2026-05-15在数据仓库建设中,事实表与维度表是两大核心组件,二者相互关联、缺一不可,共同构成数据仓库的基础架构。事实表聚焦“发生了什 ...

2026-05-15 很多数据分析师沉迷于复杂的机器学习算法,却忽略了数据分析最基础也最核心的能力——描述性统计。事实上,80%的商业分析问 ...

2026-05-15【核心关键词】互联网、机会、运营、关键词、账户、数字化、后台、客户、成本、网络、数据分析、底层逻辑、市场推广、数据反馈 ...

2026-05-14在Python数据分析中,Pandas作为核心工具库,凭借简洁高效的数据处理能力,成为数据分析从业者的必备技能。其中,基于两列(或多 ...

2026-05-14 很多人把统计学理解为“一堆公式和计算”,却忽略了它的本质——一门让数据“开口说话”的科学。真正的数据分析高手,不是会 ...

2026-05-14在零售行业存量竞争日趋激烈的当下,客户流失已成为侵蚀企业利润的“隐形杀手”——据行业数据显示,零售企业平均客户流失率高达 ...

2026-05-13当流量红利消退、用户需求日趋多元,“凭经验决策、广撒网投放”的传统营销模式早已难以为继。大数据的崛起,为企业营销提供了全 ...

2026-05-13 许多数据分析师精通Excel函数和SQL查询,但当面对一张上万行的销售明细表,要快速回答“哪个地区销量最高”“哪款产品增长最 ...

2026-05-13在手游行业存量竞争日趋激烈、流量成本持续高企的当下,“拉新”早已不是行业核心痛点,“留存”尤其是“付费留存”,成为决定手 ...

2026-05-12 很多数据分析师掌握了Excel函数、会写SQL查询,但当被问到“数据从哪里来”“数据加工有哪些步骤”“如何使用分析工具连接数 ...

2026-05-12用户调研是企业洞察客户需求、优化产品服务、制定运营策略的核心前提,而调研数据的可靠性,直接决定了决策的科学性与有效性。在 ...

2026-05-11在市场竞争日趋激烈、流量成本持续攀升的今天,企业的核心竞争力已从“获取流量”转向“挖掘客户价值”。客户作为企业最宝贵的资 ...

2026-05-11 很多数据分析师精通Excel单元格操作,熟练应用多种公式,但当被问到“表结构数据的基本处理单位是什么”“字段和记录的本质 ...

2026-05-11在互联网运营、产品优化、用户增长等领域,次日留存率是衡量产品价值、用户粘性与运营效果的核心指标,更是判断新用户是否认可产 ...

2026-05-09相关性分析是数据分析领域中用于探究两个或多个变量之间关联强度与方向的核心方法,广泛应用于科研探索、商业决策、医疗研究、社 ...

2026-05-09 数据分析师八成以上的时间在和数据表格打交道,但许多人拿到Excel后习惯性地先算、先分析,结果回头发现漏了一列关键数据, ...

2026-05-09在数据驱动运营的时代,指标是连接业务目标与实际行动的核心桥梁,是企业解读业务现状、发现问题、预判趋势的“量化标尺”。一套 ...

2026-05-08在存量竞争日趋激烈的商业时代,“以客户为中心”早已从口号落地为企业运营的核心逻辑。而客户画像作为打通“了解客户”与“服务 ...

2026-05-08