京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

R语言中大型数据集的回归

众所周知,R语言是一个依赖于内存的软件,就是说一般情况下,数据集都会被整个地复制到内存之中再被处理。对于小型或者中型的数据集,这样处理当然没有什么问题。但是对于大型的数据集,例如网上抓取的金融类型时间序列数据或者一些日志数据,这样做就有很多因为内存不足导致的问题了。

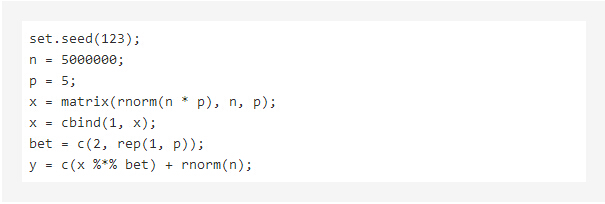

这里是一个具体的例子。在 R 中输入如下代码,创建一个叫 x 的矩阵和叫 y 的向量。

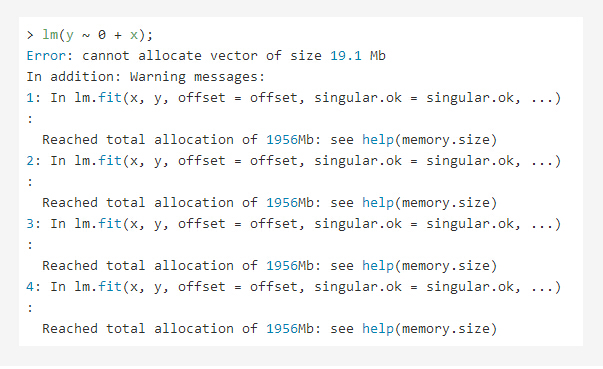

如果用内置的 lm 函数对 x 和 y 进行回归分析,就有可能出现如下错误(当然,也有可能因为内存足够而运行成功):

本文代码运行的电脑的配置是:

CPU: Intel Core i5-2410M @ 2.30 GHz

Memory: 2GB

OS: Windows 7 64-bit

R: 2.13.1 32-bit

在 R 中,每一个 numeric 数 占用 8 Bytes,所以可以估算到 x 和 y 只是占用 5000000 7 8 / 1024 ^ 2 Bytes = 267 MB,离运行的电脑的内存 2 GB 差很远。问题在于,运行 lm() 函数会生成很多额外的变量塞满内存。比如说拟合值和残差。

如果我们只是关心回归的系数,我们可以直接用矩阵运算来计算 β^ :

在本文运行的计算机中,这个命令成功执行, 而且很快(0.6秒)(我使用了一个优化版本的 Rblas, 下载)。然而,如果样本变得更加大了,这个矩阵运算也会变得不可用。可以估算出,如果样本大小为 2GB / 7 / 8 Bytes = 38347922 ,x 和 y 自己就会占用了全部内存,更不要说其他计算过程中出现的临时变量了。

怎么破?

一个方法就是用数据库来避免占用大量内存,并且直接在数据库中执行 SQL 语句等。数据库使用硬盘来保存数据,并且执行 SQL 语句时只是占用少量内存,所以基本上不用过于担心内存占用。不过有得有失,要更加关注完成任务所占用的时间。

R 支持很多数据库,其中 SQLite 是最轻量级和简单的。有一个 RSQLite 包,允许用户在 R 中对 SQLite 进行操作。这些操作包括了对 SQLite 数据库进行读写,执行 SQL 语句和在 R 中获取执行结果。所以,如果我们能够把需要的算法“翻译”到 SQL 语句版本,数据集的大小只受限于硬盘的大小和我们能够接受的执行时间。

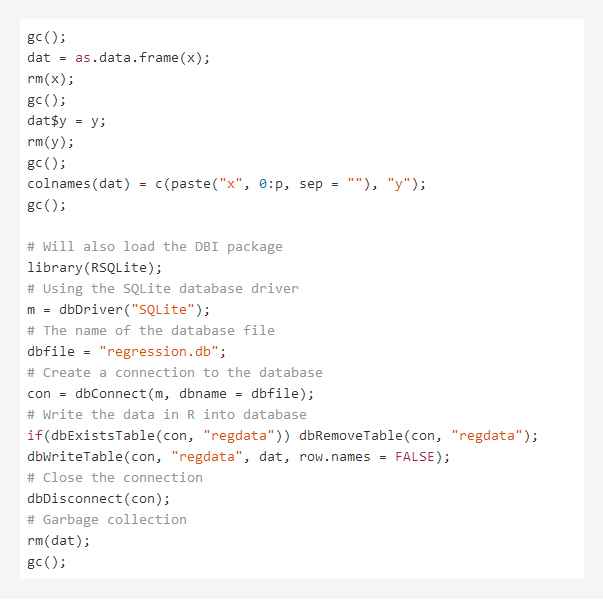

采用上面的那个例子,我这里说明我们会怎样用数据库和 SQL 语句来对数据集进行回归。首先我们要把数据塞到硬盘上面。

上述代码有很多 rm() 和 gc() ,函数,这些函数是用来移除没有用的临时变量和释放内存。当代码运行完毕的时候,你就会发现在你的工作空间中有一个 320M 左右的 regression.db 文件。然后就是最重要的一步了:把回归的算法转化为 SQL。

我们有

β^=(X′X)−1X′y

而且,无论 n 有多大,X′X 和 X′y 的大小总是 (p+1)∗(p+1) 。如果变量不是很多,R 处理矩阵逆和矩阵乘法还是很轻松的,所以我们的主要目标是用 SQL 来计算 X′X 和 X′y 。

由于 X=(x0,x1,…,xp),所以 X′X 可以表达为:

$$%

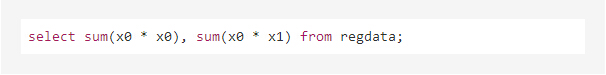

而每一个矩阵元素都可以用 SQL 来计算,比如说:

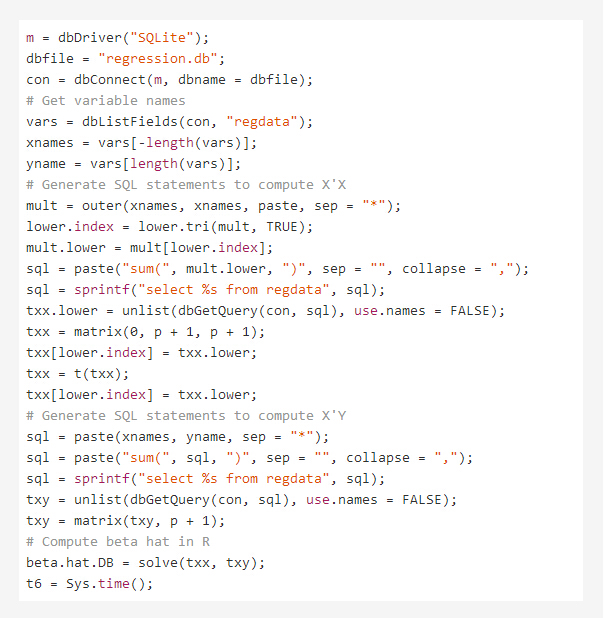

我们可以用 R 来生成 SQL 语句,然后把语句发送到 SQLite :

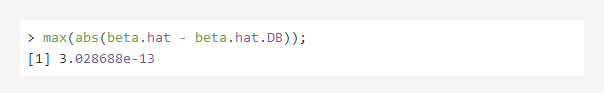

可以看出差别是舍入误差导致的。

以上计算用了大约 17 秒,远远超出矩阵运算的时间。不过它也几乎没有占用额外的内存空间。实际上我们采用了“时间换空间”的策略。此外,你可能还发现,我们可以通过多个对数据库的连接同步地计算 sum(x0*x0), sum(x0*x1), ..., sum(x5*x5) ,所以如果你有一个多核的服务器(而且硬盘足够快),你还可以通过适当的安排大量地减少运行时间。

CDA学员免费下载查看报告全文:2026全球数智化人才指数报告【CDA数据科学研究院】.pdf

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在互联网运营、产品优化、用户增长等领域,次日留存率是衡量产品价值、用户粘性与运营效果的核心指标,更是判断新用户是否认可产 ...

2026-05-09相关性分析是数据分析领域中用于探究两个或多个变量之间关联强度与方向的核心方法,广泛应用于科研探索、商业决策、医疗研究、社 ...

2026-05-09 数据分析师八成以上的时间在和数据表格打交道,但许多人拿到Excel后习惯性地先算、先分析,结果回头发现漏了一列关键数据, ...

2026-05-09在数据驱动运营的时代,指标是连接业务目标与实际行动的核心桥梁,是企业解读业务现状、发现问题、预判趋势的“量化标尺”。一套 ...

2026-05-08在存量竞争日趋激烈的商业时代,“以客户为中心”早已从口号落地为企业运营的核心逻辑。而客户画像作为打通“了解客户”与“服务 ...

2026-05-08 很多数据分析师每天与Excel打交道,但当被问到“什么是表格结构数据”“它和表结构数据有什么区别”“表格结构数据有哪些核 ...

2026-05-08在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-05-07在数字化时代,商业竞争的核心已从“经验驱动”转向“数据驱动”,越来越多的企业意识到,商业分析不是简单的数据统计与报表呈现 ...

2026-05-06在Excel数据透视表的实操中,“引用”是连接透视表与公式、辅助数据的核心操作,而相对引用作为最基础、最常用的引用方式,其设 ...

2026-05-06 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-05-06在Excel数据分析中,数据透视表是汇总、整理海量数据的高效工具,而公式则是实现数据二次计算、逻辑判断的核心功能。实际操作中 ...

2026-04-30Excel透视图是数据分析中不可或缺的工具,它能将透视表中的数据快速可视化,帮助我们直观捕捉数据规律、呈现分析结果。但在实际 ...

2026-04-30 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-04-30在中介效应分析中,人口统计学变量(如年龄、性别、学历、收入、职业等)是常见的控制变量或调节变量,其处理方式直接影响分析结 ...

2026-04-29在SQL数据库实操中,日期数据的存储与显示是高频需求,而“数字日期”(如20240520、20241231、45321)是很多开发者、数据分析师 ...

2026-04-29 很多分析师在设计标签时思路清晰,但真到落地环节却面临“数据在手,不知如何转化为可用标签”的困境:或因加工方式选择不当 ...

2026-04-29在手游行业竞争日趋白热化的当下,“流量为王”早已升级为“留存为王”,而付费用户留存率更是衡量一款手游盈利能力、运营质量的 ...

2026-04-28在日常MySQL数据库运维与开发中,经常会遇到“同一台服务器上,两个不同数据库(以下简称“源库”“目标库”)的表数据需要保持 ...

2026-04-28