京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

回归诊断主要内容

(1).误差项是否满足独立性,等方差性与正态

(2).选择线性模型是否合适

(3).是否存在异常样本

(4).回归分析是否对某个样本的依赖过重,也就是模型是否具有稳定性

(5).自变量之间是否存在高度相关,是否有多重共线性现象存在

通过了t检验与F检验,但是做为回归方程还是有问题

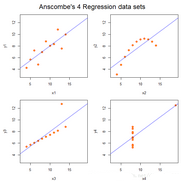

#举例说明,利用anscombe数据

## 调取数据集

data(anscombe)

## 分别调取四组数据做回归并输出回归系数等值

ff <- y ~ x

for(i in 1:4) {

ff[2:3] <- lapply(paste(c("y","x"), i, sep=""), as.name)

assign(paste("lm.",i,sep=""), lmi<-lm(ff, data=anscombe))

}

GetCoef<-function(n) summary(get(n))$coef

lapply(objects(pat="lm\\.[1-4]$"), GetCoef)

[[1]]

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3.0000909 1.1247468 2.667348 0.025734051

x1 0.5000909 0.1179055 4.241455 0.002169629

[[2]]

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3.000909 1.1253024 2.666758 0.025758941

x2 0.500000 0.1179637 4.238590 0.002178816

[[3]]

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3.0024545 1.1244812 2.670080 0.025619109

x3 0.4997273 0.1178777 4.239372 0.002176305

[[4]]

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3.0017273 1.1239211 2.670763 0.025590425

x4 0.4999091 0.1178189 4.243028 0.002164602

从计算结果可以知道,Estimate, Std. Error, t value, Pr(>|t|)这几个值完全不同,并且通过检验,进一步发现R^2,F值,p值完全相同,方差完全相同。事实上这四组数据完全不同,全部用线性回归不合适。

## 绘图

op <- par(mfrow=c(2,2), mar=.1+c(4,4,1,1), oma=c(0,0,2,0))

for(i in 1:4) {

ff[2:3] <- lapply(paste(c("y","x"), i, sep=""), as.name)

plot(ff, data =anscombe, col="red", pch=21,

bg="orange", cex=1.2, xlim=c(3,19), ylim=c(3,13))

abline(get(paste("lm.",i,sep="")), col="blue")

}

mtext("Anscombe's 4 Regression data sets",

outer = TRUE, cex=1.5)

par(op)

第1组数据适用于线性回归模型,第二组使用二次模型更加合理,第三组的一个点偏离于整体数据构成的回归直线,应该去掉。第四级做回归是不合理的,回归系只依赖一个点。在得到回归方程得到各种检验后,还要做相关的回归诊断。

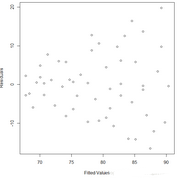

残差检验

残差的检验是检验模型的误差是否满足正态性和方差齐性,最简单直观的方法是画出残差图。观察残差分布情况,作出散点图。

#20-60岁血压与年龄分析

## (1) 回归

rt<-read.table("d:/R-TT/book1/1_R/chap06/blood.dat", header=TRUE)

lm.sol<-lm(Y~X, data=rt); lm.sol

summary(lm.sol)

Call:

lm(formula = Y ~ X, data = rt)

Residuals:

Min 1Q Median 3Q Max

-16.4786 -5.7877 -0.0784 5.6117 19.7813

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 56.15693 3.99367 14.061 < 2e-16 ***

X 0.58003 0.09695 5.983 2.05e-07 ***

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

Residual standard error: 8.146 on 52 degrees of freedom

Multiple R-squared: 0.4077, Adjusted R-squared: 0.3963

F-statistic: 35.79 on 1 and 52 DF, p-value: 2.05e-07

## (2) 残差图

pre<-fitted.values(lm.sol)

#fitted value 配适值;拟合值

res<-residuals(lm.sol)

#计算回归模型的残差

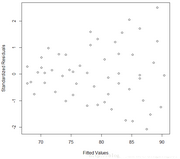

rst<-rstandard(lm.sol)

#计算回归模型标准化残差

par(mai=c(0.9, 0.9, 0.2, 0.1))

plot(pre, res, xlab="Fitted Values", ylab="Residuals")

savePlot("resid-1", type="eps")

plot(pre, rst, xlab="Fitted Values",

ylab="Standardized Residuals")

savePlot("resid-2", type="eps")

残差

标准差

## (3) 对残差作回归,利用残差绝对值与自变量(x)作回归,其程序如下:

rt$res<-res

lm.res<-lm(abs(res)~X, data=rt); lm.res

summary(lm.res)

Call:

lm(formula = abs(res) ~ X, data = rt)

Residuals:

Min 1Q Median 3Q Max

-9.7639 -2.7882 -0.1587 3.0757 10.0350

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) -1.54948 2.18692 -0.709 0.48179

X 0.19817 0.05309 3.733 0.00047 ***

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

Residual standard error: 4.461 on 52 degrees of freedom

Multiple R-squared: 0.2113, Adjusted R-squared: 0.1962

F-statistic: 13.93 on 1 and 52 DF, p-value: 0.0004705

si= -1.5495 + 0.1982x

## (4) 计算残差的标准差,利用方差(标准差的平方)的倒数作为样本点的权重,这样可以减少非齐性方差带来的影响

s<-lm.res$coefficients[1]+lm.res$coefficients[2]*rt$X

lm.weg<-lm(Y~X, data=rt, weights=1/s^2); lm.weg

summary(lm.weg)

Call:

lm(formula = Y ~ X, data = rt, weights = 1/s^2)

Weighted Residuals:

Min 1Q Median 3Q Max

-2.0230 -0.9939 -0.0327 0.9250 2.2008

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 55.56577 2.52092 22.042 < 2e-16 ***

X 0.59634 0.07924 7.526 7.19e-10 ***

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

Residual standard error: 1.213 on 52 degrees of freedom

Multiple R-squared: 0.5214, Adjusted R-squared: 0.5122

F-statistic: 56.64 on 1 and 52 DF, p-value: 7.187e-10

修正后的回归方程:Y = 55.5658 + 0.5963x

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在MySQL数据库日常查询、数据统计、后台接口开发、数据导出等场景中,开发者经常需要查询数据表除某几列之外的所有字段。例如查 ...

2026-06-09在Python网络请求、爬虫开发、接口测试、数据抓取等实操场景中,requests库是最常用的第三方请求工具,而content属性是requests ...

2026-06-09 数据分析正在重塑每一个行业。CDA认证的三本官方教材,分别对应Level I、Level II、Level III,为你铺就从业务数据分析到数 ...

2026-06-09在数字财务、智慧财税、业财融合深度推进的当下,传统财务模式下数据标准混乱、业务流程碎片化、知识无法沉淀、系统互通性差等问 ...

2026-06-08随着数字经济深度渗透各行各业,数据正式成为继土地、劳动力、资本、技术之后的第五大生产要素,是企业数字化转型、精细化运营、 ...

2026-06-08 很多数据分析师能熟练写SQL、做透视表,但当被问到“数据是从哪里来的?经过哪些加工才进入数据仓库?ETL具体做了什么?”时 ...

2026-06-08【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-05在数据库数据查询、业务报表统计、多表关联分析中,LEFT JOIN左连接是使用率最高的SQL关联查询语句。其核心特性是保留左表全部数 ...

2026-06-05 很多数据分析师能熟练地写SQL、做透视表、算描述性统计,但当被问到“如何预测用户流失概率”“如何归因销量下滑的关键因素 ...

2026-06-05任何一款产品从诞生、普及到最终退出市场,都会遵循一套固定的发展规律,这就是产品生命周期理论。在市场竞争日益激烈、产品迭代 ...

2026-06-04在Excel数据分析、办公统计、业务报表制作场景中,数据透视表是数据汇总、分类统计、快速复盘的核心工具,能够高效完成海量原始 ...

2026-06-04 很多数据分析师拿到数据就开始清洗、建模,但当被问到“这批数据属于什么类型——结构化还是非结构化?分类变量还是数值变量 ...

2026-06-04在问卷调查与社会科学数据分析中,卡方检验是最常用、最基础的非参数检验方法,广泛应用于市场调研、用户分析、行为统计、满意度 ...

2026-06-03【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-03 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-06-03逻辑回归是数据分析、机器学习、统计建模中应用最广泛的二分类预测模型,常用于风险判断、行为预测、归因分析等场景。在SPSS、Py ...

2026-06-02数字经济时代,市场竞争日趋同质化,用户消费需求愈发个性化、多元化,传统依托经验、粗放式、广撒网的营销模式弊端日益凸显。长 ...

2026-06-02 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-06-02在市场竞争日趋饱和、用户需求不断细分的当下,企业创业创新、产品迭代与市场拓展不再依赖经验决策,而是需要系统化、工具化的商 ...

2026-06-01【核心关键词】调度、岗位、数据库、企业、报表、培训、程序、数据分析、数据加工、业务部门、企业数据、调度工具、业务指标、 ...

2026-06-01