京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

前面的假设检验、方差分析基本上都是围绕差异性分析,不论是单个总体还是两个总体及以上,总之都是属于研究“区别”,从本节开始,我们关注“联系”,变量之间的关系分为 函数关系和相关关系。 本节这里重点探讨的是不同类型变量之间的相关性,千万记住一点相关性不代表因果性。除表中列出的常用方法外,还有Tetrachoric、相关系数等。

| 变量类型 | 变量类型 | 相关系数计算方法 | 示例 |

|---|---|---|---|

| 连续型变量 | 连续型变量 | Pearson(正态)/Spearman(非正态) | 商品曝光量和购买转化率 |

| 二分类变量(无序) | 连续型变量 | Point-biserial | 性别和疾病指数 |

| 无序分类变量 | 连续型变量 | 方差分析 | 不同教育水平的考试成绩 |

| 有序分类变量 | 连续型变量 | 连续指标离散化后当做有序分类 | 商品评分与购买转化率 |

| 二分类变量 | 二分类变量 | 数学公式: 检验 联合 Cramer's V | 性别和是否吸烟 |

| 二分类变量(有序) | 连续型变量 | Biserial | 乐器练习时间与考级是否通过 |

| 无序分类变量 | 无序分类变量 | 数学公式: 检验 / Fisher检验 | 手机品牌和年龄段 |

| 有序分类变量 | 无序分类变量 | 数学公式: 检验 | 满意度和手机品牌 |

| 有序分类变量 | 有序分类变量 | Spearman /Kendall Tau相关系数 | 用户等级和活跃程度等级 |

Pearson相关系数度量了两个连续变量之间的线性相关程度;

import random

import numpy as np

import pandas as pd

np.random.seed(10)

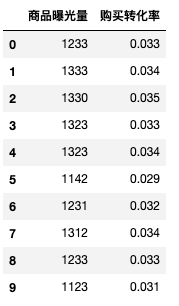

df = pd.DataFrame({'商品曝光量':[1233,1333,1330,1323,1323,1142,1231,1312,1233,1123],

'购买转化率':[0.033,0.034,0.035,0.033,0.034,0.029,0.032,0.034,0.033,0.031]})

df

pd.Series.corr(df['商品曝光量'], df['购买转化率'],method = 'pearson') # pearson相关系数

# 0.885789300493948

import scipy.stats as stats

# 假设有两个变量X和Y

X = df['商品曝光量']

Y = df['购买转化率']

# 使用spearmanr函数计算斯皮尔曼相关系数和p值

corr, p_value = stats.pearsonr(X, Y)

print("Pearson相关系数:", corr)

print("p值:", p_value)

# Pearson相关系数: 0.8857893004939478

# p值: 0.0006471519603654732

Spearman等级相关系数可以衡量非线性关系变量间的相关系数,是一种非参数的统计方法,可以用于定序变量或不满足正态分布假设的等间隔数据;

import random

import numpy as np

import pandas as pd

np.random.seed(10)

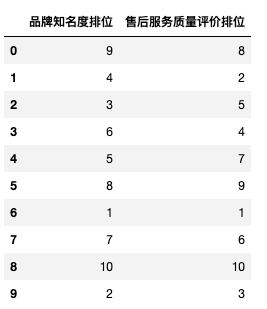

df = pd.DataFrame({'品牌知名度排位':[9,4,3,6,5,8,1,7,10,2],

'售后服务质量评价排位':[8,2,5,4,7,9,1,6,10,3]})

df

pd.Series.corr(df['品牌知名度排位'], df['售后服务质量评价排位'],method = 'spearman') # spearman秩相关

# 0.8787878787878788

import scipy.stats as stats

# 假设有两个变量X和Y

X = df['品牌知名度排位']

Y = df['售后服务质量评价排位']

# 使用spearmanr函数计算斯皮尔曼相关系数和p值

corr, p_value = stats.spearmanr(X, Y)

print("斯皮尔曼相关系数:", corr)

print("p值:", p_value)

# 斯皮尔曼相关系数: 0.8787878787878788

# p值: 0.0008138621117322101

结论:p = 0.0008<0.05,表明两变量之间的正向关系很显著。

假设我们想要研究性别对于某种疾病是否存在影响。我们有一个二元变量“性别”(男、女)和一个连续型变量“疾病指数”。我们想要计算性别与疾病指数之间的相关系数,就需要用到Point-biserial相关系数。

import scipy.stats as stats

# 创建一个列表来存储数据

gender = [0, 1, 0, 1, 1, 0]

disease_index = [3.2, 4.5, 2.8, 4.0, 3.9, 3.1]

# 使用pointbiserialr函数计算Point-biserial相关系数和p值

corr, p_value = stats.pointbiserialr(gender, disease_index)

print("Point-biserial相关系数:", corr)

print("p值:", p_value)

# Point-biserial相关系数: 0.9278305692406299

# p值: 0.007624695507848026

结论:p = 0.007<0.05,表明两变量之间的正向关系很显著。即性别与疾病指数正相关

假设我们想要比较不同教育水平的学生在CDA考试成绩上是否存在显著差异。我们有一个无序分类变量“教育水平”(高中、本科、研究生)和一个连续型变量“考试成绩”。

import pandas as pd

import statsmodels.api as sm

from statsmodels.formula.api import ols

# 创建一个DataFrame来存储数据

data = pd.DataFrame({

'教育水平': ['高中', '本科', '本科', '研究生', '高中', '本科', '研究生'],

'考试成绩': [80, 90, 85, 95, 75, 88, 92]

})

# 使用ols函数创建一个线性模型

model = ols('考试成绩 ~ C(教育水平)', data=data).fit()

# 使用anova_lm函数进行方差分析

anova_table = sm.stats.anova_lm(model, typ=2)

anova_table

结论:p = 0.0102<0.05,拒绝原假设,表明两变量之间的正向关系很显著。教育水平与考试成绩正相关

将连续型变量离散化后当做有序分类,然后用 有序分类变量 VS 有序分类变量的方法

一项研究调查了不同性别的成年人对在公众场合吸烟的态度,结果如表所示。那么,性别与对待吸烟的态度之间的相关程度

| - | 赞同 | 反对 |

|---|---|---|

| 男 | 15 | 10 |

| 女 | 10 | 26 |

import numpy as np

from scipy.stats import chi2_contingency

observed = np.array([[15, 10],

[10, 26]])

observed

chi2, p, dof, expected = chi2_contingency(observed,correction =False) # correction =False

# 卡方值

# P值

# 自由度:

# 与原数据数组同维度的对应期望值

chi2, p

#(6.3334567901234555, 0.011848116168529757)

结论:p = 0.0118<0.05,拒绝原假设,表明两变量之间的正向关系很显著。

phi = np.sqrt(chi2/n)

print("phi's V:", phi)

# phi's V: 0.3222222222222222

这里只列出 指标 和 Cramer V指标 的计算,其他计算方式请读者自行研究。

# 计算Cramer's V

contingency_table = observed

n = contingency_table.sum().sum()

phi_corr = np.sqrt(chi2 / (n * min(contingency_table.shape) - 1))

v = phi_corr / np.sqrt(min(contingency_table.shape) - 1)

print("Cramer's V:", v)

# Cramer's V: 0.22878509151645754

import numpy as np

from scipy.stats import pearsonr

# 生成随机的二元变量

binary_variable = np.random.choice([0, 1], size=100)

# 生成随机的连续变量

continuous_variable = np.random.normal(loc=0, scale=1, size=100)

# 注:此处的代码未经严格考证,请谨慎使用

def biserial_correlation(binary_variable, continuous_variable):

binary_variable_bool = binary_variable.astype(bool)

binary_mean = np.mean(binary_variable_bool)

binary_std = np.std(binary_variable_bool)

binary_variable_norm = (binary_variable_bool - binary_mean) / binary_std

corr, _ = pearsonr(binary_variable_norm, continuous_variable)

biserial_corr = corr * (np.std(continuous_variable) / binary_std)

return biserial_corr

# 计算Biserial相关系数

biserial_corr = biserial_correlation(binary_variable, continuous_variable)

print("Biserial相关系数:", biserial_corr)

Biserial相关系数: -0.2061772328681707

参考 检验

参考 检验

Kendall秩相关系数也是一种非参数的等级相关度量,类似于Spearman等级相关系数。

import random

import numpy as np

import pandas as pd

np.random.seed(10)

df = pd.DataFrame({'品牌知名度排位':[9,4,3,6,5,8,1,7,10,2],

'售后服务质量评价排位':[8,2,5,4,7,9,1,6,10,3]})

df

pd.Series.corr(df['品牌知名度排位'], df['售后服务质量评价排位'],method = 'kendall') # Kendall Tau相关系数

# 0.7333333333333333

from scipy.stats import kendalltau

# 两个样本数据

x = df['品牌知名度排位']

y = df['售后服务质量评价排位']

# 计算Kendall Tau相关系数

correlation, p_value = kendalltau(x, y)

print("Kendall Tau相关系数:", correlation)

print("p值:", p_value)

# Kendall Tau相关系数: 0.7333333333333333

# p值: 0.002212852733686067

浮生皆纵,恍如一梦,让我们只争朝夕,不负韶华!

下期将为大家带来《统计学极简入门》之 再看t检验、F检验、检验

《CDA一级教材》适合CDA一级考生备考,也适合业务及数据分析岗位的从业者提升自我。完整电子版已上线CDA网校,累计已有10万+在读~

免费加入阅读:https://edu.cda.cn/goods/show/3151?targetId=5147&preview=0

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-05在数据库数据查询、业务报表统计、多表关联分析中,LEFT JOIN左连接是使用率最高的SQL关联查询语句。其核心特性是保留左表全部数 ...

2026-06-05 很多数据分析师能熟练地写SQL、做透视表、算描述性统计,但当被问到“如何预测用户流失概率”“如何归因销量下滑的关键因素 ...

2026-06-05任何一款产品从诞生、普及到最终退出市场,都会遵循一套固定的发展规律,这就是产品生命周期理论。在市场竞争日益激烈、产品迭代 ...

2026-06-04在Excel数据分析、办公统计、业务报表制作场景中,数据透视表是数据汇总、分类统计、快速复盘的核心工具,能够高效完成海量原始 ...

2026-06-04 很多数据分析师拿到数据就开始清洗、建模,但当被问到“这批数据属于什么类型——结构化还是非结构化?分类变量还是数值变量 ...

2026-06-04在问卷调查与社会科学数据分析中,卡方检验是最常用、最基础的非参数检验方法,广泛应用于市场调研、用户分析、行为统计、满意度 ...

2026-06-03【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-03 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-06-03逻辑回归是数据分析、机器学习、统计建模中应用最广泛的二分类预测模型,常用于风险判断、行为预测、归因分析等场景。在SPSS、Py ...

2026-06-02数字经济时代,市场竞争日趋同质化,用户消费需求愈发个性化、多元化,传统依托经验、粗放式、广撒网的营销模式弊端日益凸显。长 ...

2026-06-02 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-06-02在市场竞争日趋饱和、用户需求不断细分的当下,企业创业创新、产品迭代与市场拓展不再依赖经验决策,而是需要系统化、工具化的商 ...

2026-06-01【核心关键词】调度、岗位、数据库、企业、报表、培训、程序、数据分析、数据加工、业务部门、企业数据、调度工具、业务指标、 ...

2026-06-01 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-06-01在数据统计分析、数据清洗、异常值识别与数据分布研究中,箱型图是最直观、高效、专业的可视化分析工具。相较于柱状图、折线图仅 ...

2026-05-29Tkinter是Python内置的标准GUI图形界面库,具备无需额外安装、调用简单、兼容性强、轻量化高效等优势,是Python快速开发桌面小程 ...

2026-05-29 很多分析师在设计标签时思路清晰,但真到落地环节却面临“数据在手,不知如何转化为可用标签”的困境:或因加工方式选择不当 ...

2026-05-29【核心关键词】大数据、经理、专业、金融、客户、传统、建模、数据产品、互联网金融、产品经理、数据分析、金融行业、数据模型 ...

2026-05-28 很多分析师每天和数据打交道,但当被问到“标签是什么”“标签和指标有什么区别”“标签体系如何设计”时,却常常答不上来。 ...

2026-05-28