京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

前面的假设检验、方差分析基本上都是围绕差异性分析,不论是单个总体还是两个总体及以上,总之都是属于研究“区别”,从本节开始,我们关注“联系”,变量之间的关系分为 函数关系和相关关系。 本节这里重点探讨的是不同类型变量之间的相关性,千万记住一点相关性不代表因果性。除表中列出的常用方法外,还有Tetrachoric、相关系数等。

| 变量类型 | 变量类型 | 相关系数计算方法 | 示例 |

|---|---|---|---|

| 连续型变量 | 连续型变量 | Pearson(正态)/Spearman(非正态) | 商品曝光量和购买转化率 |

| 二分类变量(无序) | 连续型变量 | Point-biserial | 性别和疾病指数 |

| 无序分类变量 | 连续型变量 | 方差分析 | 不同教育水平的考试成绩 |

| 有序分类变量 | 连续型变量 | 连续指标离散化后当做有序分类 | 商品评分与购买转化率 |

| 二分类变量 | 二分类变量 | 数学公式: 检验 联合 Cramer's V | 性别和是否吸烟 |

| 二分类变量(有序) | 连续型变量 | Biserial | 乐器练习时间与考级是否通过 |

| 无序分类变量 | 无序分类变量 | 数学公式: 检验 / Fisher检验 | 手机品牌和年龄段 |

| 有序分类变量 | 无序分类变量 | 数学公式: 检验 | 满意度和手机品牌 |

| 有序分类变量 | 有序分类变量 | Spearman /Kendall Tau相关系数 | 用户等级和活跃程度等级 |

Pearson相关系数度量了两个连续变量之间的线性相关程度;

import random

import numpy as np

import pandas as pd

np.random.seed(10)

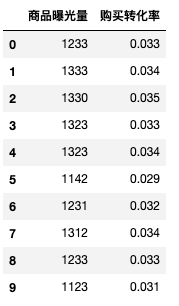

df = pd.DataFrame({'商品曝光量':[1233,1333,1330,1323,1323,1142,1231,1312,1233,1123],

'购买转化率':[0.033,0.034,0.035,0.033,0.034,0.029,0.032,0.034,0.033,0.031]})

df

pd.Series.corr(df['商品曝光量'], df['购买转化率'],method = 'pearson') # pearson相关系数

# 0.885789300493948

import scipy.stats as stats

# 假设有两个变量X和Y

X = df['商品曝光量']

Y = df['购买转化率']

# 使用spearmanr函数计算斯皮尔曼相关系数和p值

corr, p_value = stats.pearsonr(X, Y)

print("Pearson相关系数:", corr)

print("p值:", p_value)

# Pearson相关系数: 0.8857893004939478

# p值: 0.0006471519603654732

Spearman等级相关系数可以衡量非线性关系变量间的相关系数,是一种非参数的统计方法,可以用于定序变量或不满足正态分布假设的等间隔数据;

import random

import numpy as np

import pandas as pd

np.random.seed(10)

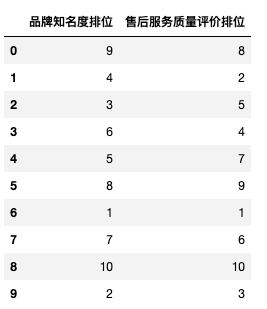

df = pd.DataFrame({'品牌知名度排位':[9,4,3,6,5,8,1,7,10,2],

'售后服务质量评价排位':[8,2,5,4,7,9,1,6,10,3]})

df

pd.Series.corr(df['品牌知名度排位'], df['售后服务质量评价排位'],method = 'spearman') # spearman秩相关

# 0.8787878787878788

import scipy.stats as stats

# 假设有两个变量X和Y

X = df['品牌知名度排位']

Y = df['售后服务质量评价排位']

# 使用spearmanr函数计算斯皮尔曼相关系数和p值

corr, p_value = stats.spearmanr(X, Y)

print("斯皮尔曼相关系数:", corr)

print("p值:", p_value)

# 斯皮尔曼相关系数: 0.8787878787878788

# p值: 0.0008138621117322101

结论:p = 0.0008<0.05,表明两变量之间的正向关系很显著。

假设我们想要研究性别对于某种疾病是否存在影响。我们有一个二元变量“性别”(男、女)和一个连续型变量“疾病指数”。我们想要计算性别与疾病指数之间的相关系数,就需要用到Point-biserial相关系数。

import scipy.stats as stats

# 创建一个列表来存储数据

gender = [0, 1, 0, 1, 1, 0]

disease_index = [3.2, 4.5, 2.8, 4.0, 3.9, 3.1]

# 使用pointbiserialr函数计算Point-biserial相关系数和p值

corr, p_value = stats.pointbiserialr(gender, disease_index)

print("Point-biserial相关系数:", corr)

print("p值:", p_value)

# Point-biserial相关系数: 0.9278305692406299

# p值: 0.007624695507848026

结论:p = 0.007<0.05,表明两变量之间的正向关系很显著。即性别与疾病指数正相关

假设我们想要比较不同教育水平的学生在CDA考试成绩上是否存在显著差异。我们有一个无序分类变量“教育水平”(高中、本科、研究生)和一个连续型变量“考试成绩”。

import pandas as pd

import statsmodels.api as sm

from statsmodels.formula.api import ols

# 创建一个DataFrame来存储数据

data = pd.DataFrame({

'教育水平': ['高中', '本科', '本科', '研究生', '高中', '本科', '研究生'],

'考试成绩': [80, 90, 85, 95, 75, 88, 92]

})

# 使用ols函数创建一个线性模型

model = ols('考试成绩 ~ C(教育水平)', data=data).fit()

# 使用anova_lm函数进行方差分析

anova_table = sm.stats.anova_lm(model, typ=2)

anova_table

结论:p = 0.0102<0.05,拒绝原假设,表明两变量之间的正向关系很显著。教育水平与考试成绩正相关

将连续型变量离散化后当做有序分类,然后用 有序分类变量 VS 有序分类变量的方法

一项研究调查了不同性别的成年人对在公众场合吸烟的态度,结果如表所示。那么,性别与对待吸烟的态度之间的相关程度

| - | 赞同 | 反对 |

|---|---|---|

| 男 | 15 | 10 |

| 女 | 10 | 26 |

import numpy as np

from scipy.stats import chi2_contingency

observed = np.array([[15, 10],

[10, 26]])

observed

chi2, p, dof, expected = chi2_contingency(observed,correction =False) # correction =False

# 卡方值

# P值

# 自由度:

# 与原数据数组同维度的对应期望值

chi2, p

#(6.3334567901234555, 0.011848116168529757)

结论:p = 0.0118<0.05,拒绝原假设,表明两变量之间的正向关系很显著。

phi = np.sqrt(chi2/n)

print("phi's V:", phi)

# phi's V: 0.3222222222222222

这里只列出 指标 和 Cramer V指标 的计算,其他计算方式请读者自行研究。

# 计算Cramer's V

contingency_table = observed

n = contingency_table.sum().sum()

phi_corr = np.sqrt(chi2 / (n * min(contingency_table.shape) - 1))

v = phi_corr / np.sqrt(min(contingency_table.shape) - 1)

print("Cramer's V:", v)

# Cramer's V: 0.22878509151645754

import numpy as np

from scipy.stats import pearsonr

# 生成随机的二元变量

binary_variable = np.random.choice([0, 1], size=100)

# 生成随机的连续变量

continuous_variable = np.random.normal(loc=0, scale=1, size=100)

# 注:此处的代码未经严格考证,请谨慎使用

def biserial_correlation(binary_variable, continuous_variable):

binary_variable_bool = binary_variable.astype(bool)

binary_mean = np.mean(binary_variable_bool)

binary_std = np.std(binary_variable_bool)

binary_variable_norm = (binary_variable_bool - binary_mean) / binary_std

corr, _ = pearsonr(binary_variable_norm, continuous_variable)

biserial_corr = corr * (np.std(continuous_variable) / binary_std)

return biserial_corr

# 计算Biserial相关系数

biserial_corr = biserial_correlation(binary_variable, continuous_variable)

print("Biserial相关系数:", biserial_corr)

Biserial相关系数: -0.2061772328681707

参考 检验

参考 检验

Kendall秩相关系数也是一种非参数的等级相关度量,类似于Spearman等级相关系数。

import random

import numpy as np

import pandas as pd

np.random.seed(10)

df = pd.DataFrame({'品牌知名度排位':[9,4,3,6,5,8,1,7,10,2],

'售后服务质量评价排位':[8,2,5,4,7,9,1,6,10,3]})

df

pd.Series.corr(df['品牌知名度排位'], df['售后服务质量评价排位'],method = 'kendall') # Kendall Tau相关系数

# 0.7333333333333333

from scipy.stats import kendalltau

# 两个样本数据

x = df['品牌知名度排位']

y = df['售后服务质量评价排位']

# 计算Kendall Tau相关系数

correlation, p_value = kendalltau(x, y)

print("Kendall Tau相关系数:", correlation)

print("p值:", p_value)

# Kendall Tau相关系数: 0.7333333333333333

# p值: 0.002212852733686067

浮生皆纵,恍如一梦,让我们只争朝夕,不负韶华!

下期将为大家带来《统计学极简入门》之 再看t检验、F检验、检验

《CDA一级教材》适合CDA一级考生备考,也适合业务及数据分析岗位的从业者提升自我。完整电子版已上线CDA网校,累计已有10万+在读~

免费加入阅读:https://edu.cda.cn/goods/show/3151?targetId=5147&preview=0

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

用户调研是企业洞察客户需求、优化产品服务、制定运营策略的核心前提,而调研数据的可靠性,直接决定了决策的科学性与有效性。在 ...

2026-05-11在市场竞争日趋激烈、流量成本持续攀升的今天,企业的核心竞争力已从“获取流量”转向“挖掘客户价值”。客户作为企业最宝贵的资 ...

2026-05-11 很多数据分析师精通Excel单元格操作,熟练应用多种公式,但当被问到“表结构数据的基本处理单位是什么”“字段和记录的本质 ...

2026-05-11在互联网运营、产品优化、用户增长等领域,次日留存率是衡量产品价值、用户粘性与运营效果的核心指标,更是判断新用户是否认可产 ...

2026-05-09相关性分析是数据分析领域中用于探究两个或多个变量之间关联强度与方向的核心方法,广泛应用于科研探索、商业决策、医疗研究、社 ...

2026-05-09 数据分析师八成以上的时间在和数据表格打交道,但许多人拿到Excel后习惯性地先算、先分析,结果回头发现漏了一列关键数据, ...

2026-05-09在数据驱动运营的时代,指标是连接业务目标与实际行动的核心桥梁,是企业解读业务现状、发现问题、预判趋势的“量化标尺”。一套 ...

2026-05-08在存量竞争日趋激烈的商业时代,“以客户为中心”早已从口号落地为企业运营的核心逻辑。而客户画像作为打通“了解客户”与“服务 ...

2026-05-08 很多数据分析师每天与Excel打交道,但当被问到“什么是表格结构数据”“它和表结构数据有什么区别”“表格结构数据有哪些核 ...

2026-05-08在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07在数据分析、计量研究等场景中,回归分析是探究变量间量化关系的核心方法,无论是简单的一元线性回归,还是复杂的多元线性回归、 ...

2026-05-07 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-05-07在数字化时代,商业竞争的核心已从“经验驱动”转向“数据驱动”,越来越多的企业意识到,商业分析不是简单的数据统计与报表呈现 ...

2026-05-06在Excel数据透视表的实操中,“引用”是连接透视表与公式、辅助数据的核心操作,而相对引用作为最基础、最常用的引用方式,其设 ...

2026-05-06 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-05-06在Excel数据分析中,数据透视表是汇总、整理海量数据的高效工具,而公式则是实现数据二次计算、逻辑判断的核心功能。实际操作中 ...

2026-04-30Excel透视图是数据分析中不可或缺的工具,它能将透视表中的数据快速可视化,帮助我们直观捕捉数据规律、呈现分析结果。但在实际 ...

2026-04-30 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-04-30在中介效应分析中,人口统计学变量(如年龄、性别、学历、收入、职业等)是常见的控制变量或调节变量,其处理方式直接影响分析结 ...

2026-04-29在SQL数据库实操中,日期数据的存储与显示是高频需求,而“数字日期”(如20240520、20241231、45321)是很多开发者、数据分析师 ...

2026-04-29