2018-10-31

阅读量:

1509

支持向量机 - 分类(SVM)

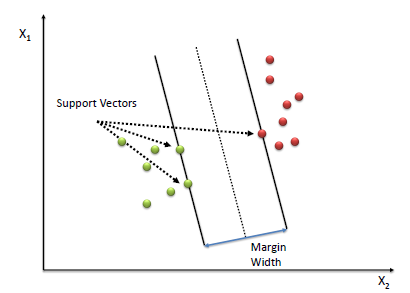

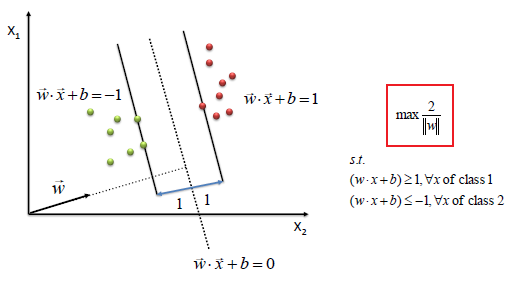

支持向量机(SVM)通过找到最大化两个类之间的余量的超平面来执行分类。定义超平面的向量(个案)是支持向量。

算法

- 定义最佳超平面:最大化边距

- 针对非线性可分的问题扩展上述定义:对错误分类进行惩罚。

- 将数据映射到高维空间,更容易使用线性决策表面进行分类:重新设计问题,以便将数据隐式映射到此空间。

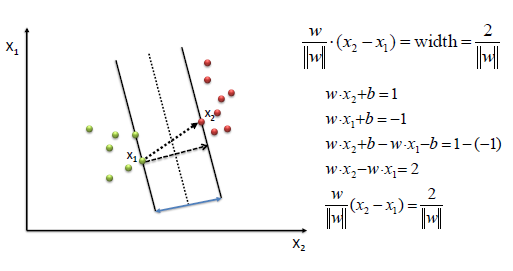

要定义最佳超平面,我们需要最大化边距(w)的宽度。

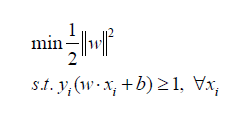

我们通过使用二次规划求解以下目标函数来找到w和b。

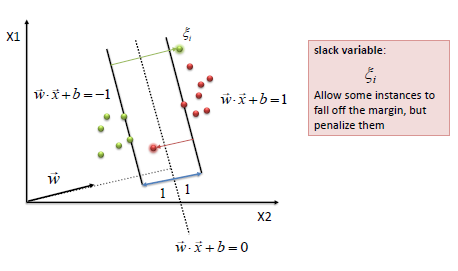

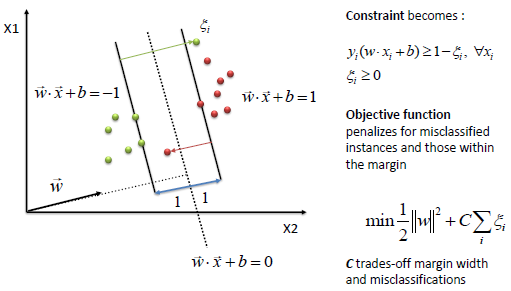

SVM的优点在于,如果数据是线性可分的,则存在唯一的全局最小值。理想的SVM分析应该产生一个超平面,将矢量(个体)完全分离为两个非重叠的类。但是,完全分离可能是不可能的,或者可能导致模型具有很多情况,模型无法正确分类。在这种情况下,SVM找到最大化边距的超平面,并最大限度地减少错误分类。

该算法尝试将松弛变量保持为零,同时使裕度最大化。但是,它并没有最大限度地减少错误分类的数量(NP完全问题),而是距离边缘超平面的距离之和。

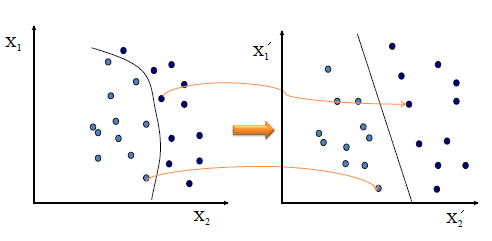

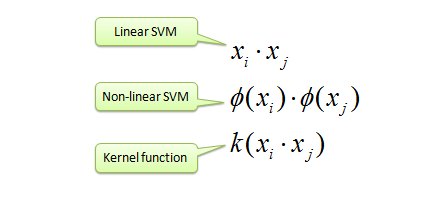

分离两组数据的最简单方法是使用直线(1维),平面(2维)或N维超平面。然而,存在非线性区域可以更有效地分离组的情况。SVM通过使用内核函数(非线性)将数据映射到不能使用超平面(线性)进行分离的不同空间来处理此问题。这意味着线性学习机在高维特征空间中学习非线性函数,而系统的容量由不依赖于空间维度的参数控制。这称为内核技巧这意味着内核函数将数据转换为更高维度的特征空间,以便可以执行线性分离。

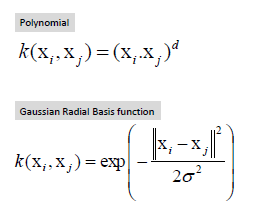

将数据映射到新空间,然后获取新向量的内积。数据内积的图像是数据图像的内积。两个内核函数如下所示。

0.0000

0.0000

0

0

2

2

关注作者

关注作者

收藏

收藏

评论(0)

发表评论

发表评论

暂无数据

推荐帖子

0条评论

0条评论

0条评论